- Czy sztuczna inteligencja może się zbuntować? Może, ale inaczej niż myślicie

- Kradną nam pracę!

- Czy maszyna może zabić człowieka?

- Czy bunt maszyn będzie świadomy?

- Bezmyślny buntownik

Czy maszyna może zabić człowieka?

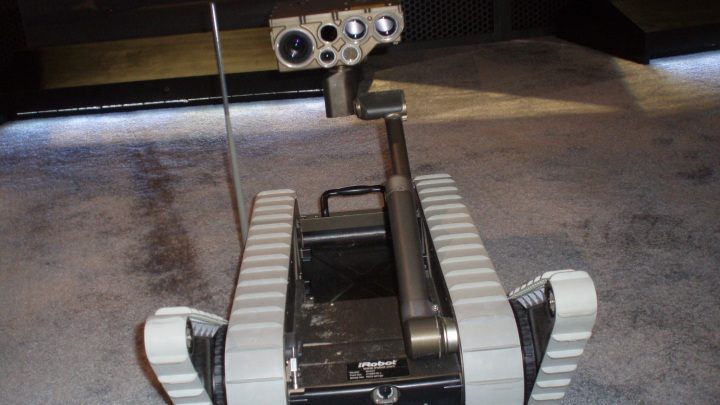

Teoretycznie już teraz moglibyśmy powierzyć maszynom decydowanie o tym, czy strzelać, czy nie. Pojazd lub automat wartowniczy otwierający ogień w stronę wykrytego ruchu albo źródła ciepła to coś, co mógłby skonstruować zespół studentów. Póki co byłoby to jednak rozwiązanie niemal losowe, przypominające tłuczenie pałką na oślep. Pomyłki i strzelanie do cywilów czy własnych żołnierzy stałyby się codziennością. Dlatego wojskowi chcą czegoś więcej.

Czołowe armie świata prowadzą zaawansowane prace nad systemami wizualnej identyfikacji swój-obcy. Według przedstawicieli producentów Super aEgis II powstanie w ciągu najbliższych kilku lat. Przyczyni się do zwiększenia autonomiczności wojskowych robotów.

Dr Robert Czulda

Większość z nas nie zdaje sobie sprawy, jak wiele problemów się z tym wiąże. Algorytm robota bojowego musi być zgodny z konwencjami międzynarodowymi. Musi na przykład brać pod uwagę, że przeciwnik schował się na cmentarzu, który jest terenem chronionym przez prawo.

Robot bojowy musiałby także umieć odróżniać od siebie żołnierza, uzbrojonego bojownika i cywila. Co więcej, strzelanie do żołnierzy, którzy się poddali, również jest zabronione. W jaki sposób robot ma się w tym rozeznać? Zwłaszcza w konfliktach asymetrycznych, w których przeciwnik od cywila różni się jedynie bronią trzymaną w ręku albo ukrytą pod ubraniem.

Wydaje się, że to rzecz nie do przeskoczenia, że maszyna nigdy nie pojmie złożoności ludzkich emocji i zachowań. Chcielibyśmy tak myśleć, ale to wcale nie musi być prawda.

Nastrój to tylko etykieta. Nazwa zestawu procesów zachodzących w układzie nerwowym człowieka, który może powodować pewne reakcje. Drgnięcia powieki, naprężenie mięśni, zmianę temperatury czy oporu skóry. To, co uczymy się rozpoznawać, to właśnie te reakcje i w ten sposób określamy czyjś nastrój. A w dalszej kolejności uczymy się przewidywać te reakcje, a więc i nastroje. Kolejnym etapem jest analiza danych i wskazanie na tej podstawie, jakie bodźce mogą wpływać na emocje i nastroje. Stąd tylko krok do znajdowania optymalnych strategii wpływania – czy to na pojedynczego człowieka, czy na całe społeczności.

Piotr Biczyk, QED Software

Algorytmy są w stanie analizować ogromne ilości danych, a bojowa maszyna może być wyposażona w czujniki, które mogłyby pomóc jej określić nastrój stojącego przed nią człowieka. Czy to pozwoliłoby odróżnić cywila wystraszonego widokiem bojowego robota od bojownika, który denerwuje się, bo zaraz ma otworzyć ogień? To całkiem możliwe, ale wiele zależy od tego, czy uda się dostarczyć algorytmom wystarczająco dużo danych do nauki. Otwarte pytanie brzmi: w jaki sposób te dane zdobywać?

JAK ROBI TO TESLA?

Wiele firm próbuje stworzyć samochód, który poruszałby się samodzielnie po drogach. To bardzo trudne zadanie. Na drodze może zdarzyć się wszystko, a samochód musi na to zareagować. Dlatego Tesla, szykując się do stworzenia takiej maszyny, buduje swoje załogowe modele w taki sposób, by zbierały jak najwięcej danych. Informacje zapisane w czasie setek tysięcy przejechanych kilometrów ostatecznie mają sprawić, że autonomiczne maszyny będą wiedziały, co robić.

Wciąż trwa dyskusja, czy wojna przy użyciu maszyn będzie etyczna. Przeciwnicy mówią, że rządy poszczególnych krajów mogą zbyt chętnie rozpoczynać wojny, jeśli będą wiedziały, że stawką nie jest ludzkie życie. Sugerują także, że maszyna nie ma litości i po prostu realizuje swój program, nawet tam, gdzie człowiek by się zawahał.

Z drugiej strony, zwolennicy przypominają, że żołnierze w czasie działań wojennych zbyt często tracą nad sobą kontrolę. Widok rannych i zmarłych towarzyszy budzi nienawiść do przeciwnika, która czasem kończy się egzekucjami jeńców, torturami, gwałtami, rabunkami. Armia maszyn nie dokonałaby masakry w Nankinie… O ile oczywiście jej właściciel nie wpisałby tego w ich oprogramowanie.

Ostatecznie możemy uznać, że współczesne armie będą coraz bardziej nasycone systemami SI. Choćby dlatego, że tego rodzaju rozwiązania są skuteczne. Pytanie brzmi: czy gdy już powstaną sieci, kierujące całymi flotami i armiami, możliwy będzie bunt?