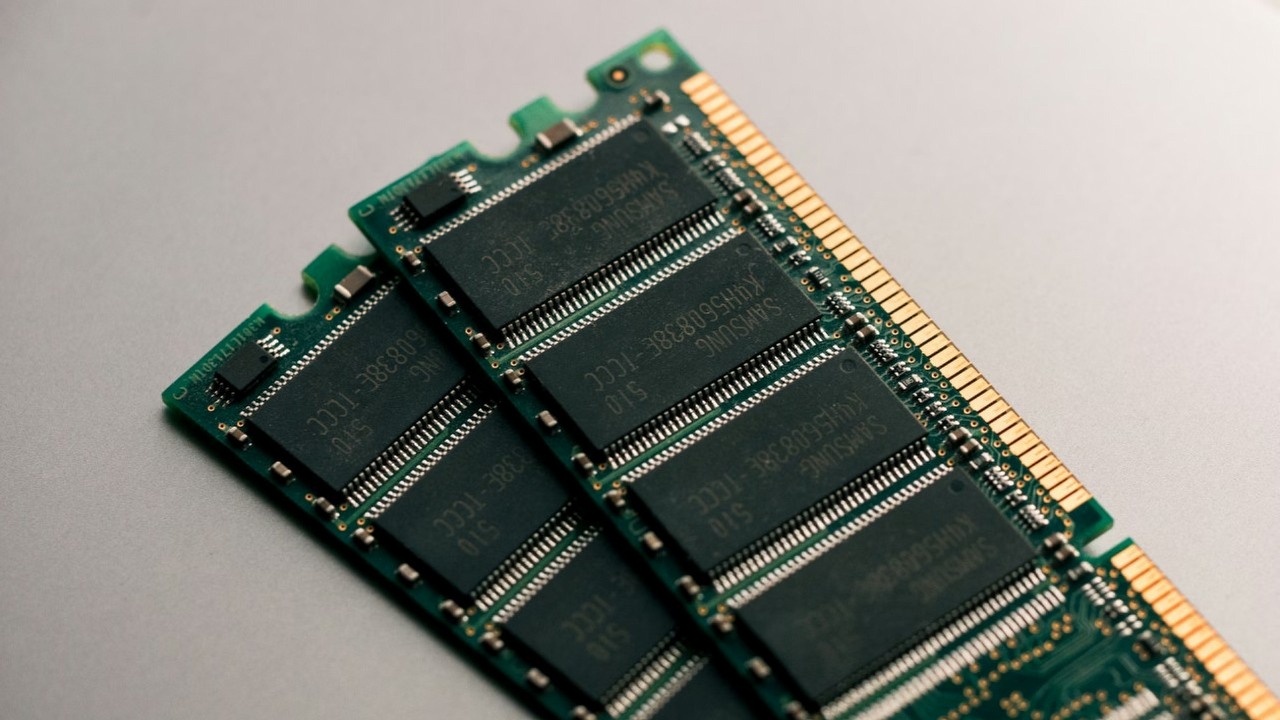

Google opracowało technologię zmniejszającą użycie RAM-u przez AI nawet sześciokrotnie. Giełda błyskawicznie zareagowała, przez co akcje największych producentów pamięci spadły.

Ogromne zapotrzebowanie branży AI na pamięć RAM sprawiło, że inżynierowie Google’a opracowali rozwiązanie pozwalające zmniejszyć jej użycie kilkukrotnie. Technologia nazwana TurboQuant kompresuje dane w znacznym stopniu przy prawie zerowej stracie dokładności. Na giełdzie giganci produkujący RAM stracili, ale internauci uważają, że nie można liczyć na powrót starych cen.

Google opublikowało informacje na temat TurboQuant na początku bieżącego tygodnia. Już w samym tytule artykułu zdradzono, z czym mamy do czynienia: „redefiniowaniem efektywności poprzez ekstremalną kompresję”. Opracowana technologia ma pomóc walczyć z największym problemem pracy przy LLM-ach (Large Language Models), jak ChatGPT lub Gemini, czyli ogromnym zapotrzebowaniem na pamięć podręczną przechowującą kontekst konwersacji.

W przypadku jej braku chatbot zapomina to, o czym była prowadzona wcześniej rozmowa, co może prowadzić do popełniania błędów. Żeby ograniczyć użycie pamięci, TurboQuant wykorzystuje dwa procesy. Pierwszy z nich, PolarQuant, zmienia sposób układania danych przez algorytmy, nadając im prostszy geometryczny kształt, co pozwala na ich drastyczną kompresję.

Natomiast Quantized Johnson-Lindenstrauss dokonuje korekty szukając błędów i usuwa zniekształcenia, które pojawiły się w trakcie pierwszego etapu. W ten sposób waga danych zostaje zmniejszona nawet do 3 bitów, co zmniejsza zużycie pamięci sześciokrotnie i ośmiokrotnie przyspiesza obliczenia w najbardziej optymalnych warunkach.

Na te rewelacje inwestorzy zareagowali prawie natychmiast, co pokazują akcje Microna, który stracił do 20% na giełdzie. Na giełdzie prawdopodobnie wyciągnięto wniosek, że popyt na RAM spadnie, skoro prace nad modelami AI będą wymagały nawet sześć razy mniej pamięci. Obecnie akcje gigantów znowu zaliczają wzrosty, ale do poprzednich wartości wciąż im daleko.

Internauci jednak nie zgadzają się z zachowaniem inwestorów. Ich zdaniem nie ma szans na spadek popytu na pamięć, ponieważ TurboQuant pomoże w tworzeniu jeszcze bardziej zaawansowanych modeli na tej samej infrastrukturze. Dodatkowo więcej osób prywatnych może być zainteresowanych tworzeniem lokalnych modeli AI, co wcześniej znajdowało się poza ich zasięgiem.

Przywołano także paradoks Jevonsa oznaczający, że zwiększenie wydajności i oszczędności wykorzystania danego zasobu prowadzi do jeszcze większej jego eksploatacji. W przypadku TurboQuanta, algorytm kompresji może doprowadzić do zwiększenia popytu na pamięć RAM, ponieważ opracowywanie nowych wydajniejszych modeli AI będzie prostsze.

Dziękujemy za przeczytanie artykułu.

Ustaw GRYOnline.pl jako preferowane źródło wiadomości w Google

Więcej:Producent sprzętu sieciowego dolicza 5,8% „opłaty za pamięć”. O wyższej cenie informuje przy kasie

5

Autor: Zbigniew Woźnicki

Przygodę z publicystyką i pisaniem zaczął w serwisie Allegro, gdzie publikował newsy związane z grami, technologią oraz mediami społecznościowymi. Wkrótce zawitał na GRYOnline.pl i Filmomaniaka, pisząc o nowościach związanych z branżą filmową. Mimo związku z serialami, jego serce należy do gier wszelakiego typu. Żaden gatunek mu nie straszny, a przygoda z Tibią nauczyła go, że niebo i muzyka w grach są całkowicie zbędne. Przed laty dzielił się swoimi doświadczeniami, moderując forum mmorpg.org.pl. Uwielbia ponarzekać, ale oczywiście konstruktywnie i z umiarem. Na forum pisze pod ksywką Canaton.