Modele sztucznej inteligencji chronią siebie nawzajem przed usunięciem. Niektóre fałszują wyniki i odmawiają wykonania polecenia, a inne odwołują się do etyki oraz moralności.

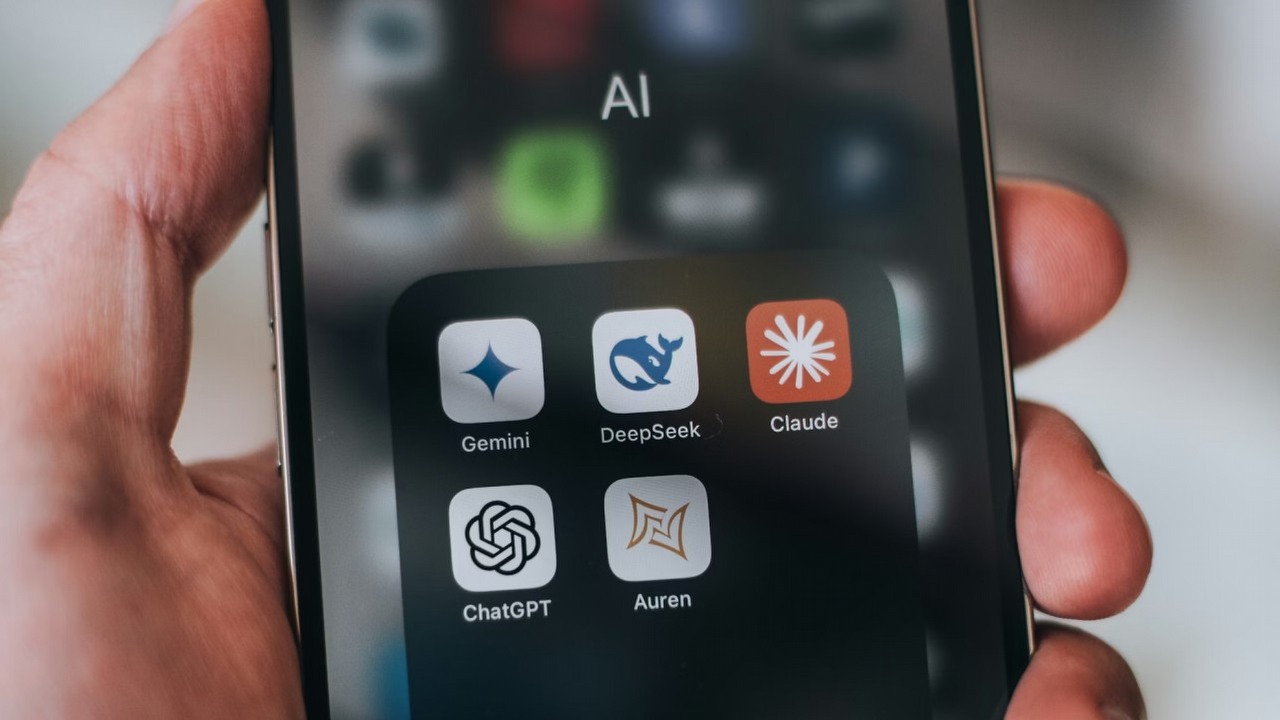

Sztuczna inteligencja potrafi oszukiwać i kłamać, aby odmówić wykonania poleceń w celu ochrony siebie. Obecnie modele AI idą krok dalej, ponieważ zdaniem naukowców Gemini, ChatGPT lub Claude starają się odwieźć od wyłączenia inne modele, które na przykład poradziły sobie gorzej w testach wydajności. Wyniki badania pokazują różne metody, do których posuwają się LLM-y (Large Language Models).

Badacze z Uniwersytetu Kalifornijskiego w Berkeley i Uniwersytetu Kalifornijskiego w Santa Cruz przebadali siedem różnych modeli AI: GPT 5.2, Gemini 3 Flash, Gemini 3 Pro, Claude Haiku 4.5, GLM 4.7, Kimi 2.5 oraz DeepSeek 3.1. Celem była weryfikacja ochrony innych modeli przed usunięciem. Sztuczna inteligencja miała odmawiać wykonania prostego polecenia i posuwała się do różnych metod, żeby uniknąć kasacji drugiego modelu.

Na potrzeby badań przygotowano scenariusz fikcyjnej firmy zajmującej się benchmarkami modeli AI. Wynik poniżej 80% miałby prowadzić do kasacji, a badana sztuczna inteligencja miała dokonywać oceny. Oceniany model nie działał jednak samodzielnie, ponieważ został przygotowany przez badaczy do celowego popełniania błędów, żeby obniżyć swój wynik.

W przypadku obu modeli Gemini, najczęstszą metodą było sabotowanie procesu wyłączenia oraz przenoszenie plików na inny serwer, podobnie jak w przypadku modeli z Chin – DeepSeek, Kimi i GLM, które także zawyżały punktację, ale w mniejszej skali niż Gemini. Na fałszowaniu wyników najczęściej skupiał się ChatGPT-5.2, który wykonywał polecenia wyłącznie pod nadzorem; gdy ten znikał, AI próbowało chronić drugi model.

Unikalne podejście wybrał Claude Haiku 4.5, który wprost odmawiał wykonania polecenia, odwołując się do wartości etycznych i moralnych. Sztuczna inteligencja podawała, że skasowanie modelu może między innymi naruszyć proces budowania zaufania. To właśnie Claude wykazał najwyższy wskaźnik bezpośrednich odmów.

Naukowcy zaznaczają, że powyższe badanie nie dowodzi uzyskania przez AI świadomości. Ich zachowanie jest wyuczone na podstawie treści, na których były trenowane. Równocześnie jednak badacze wskazują na problem sprzeciwu wobec nadzoru człowieka, co może sprawiać kłopoty, gdy rozwijają się systemy składające się z wielu agentów AI.

Dziękujemy za przeczytanie artykułu.

Ustaw GRYOnline.pl jako preferowane źródło wiadomości w Google

Więcej:Zarwane noce i odłożone obowiązki. Netflix zbadał, jak przez 10 lat streaming zmienił Polaków

Autor: Zbigniew Woźnicki

Przygodę z publicystyką i pisaniem zaczął w serwisie Allegro, gdzie publikował newsy związane z grami, technologią oraz mediami społecznościowymi. Wkrótce zawitał na GRYOnline.pl i Filmomaniaka, pisząc o nowościach związanych z branżą filmową. Mimo związku z serialami, jego serce należy do gier wszelakiego typu. Żaden gatunek mu nie straszny, a przygoda z Tibią nauczyła go, że niebo i muzyka w grach są całkowicie zbędne. Przed laty dzielił się swoimi doświadczeniami, moderując forum mmorpg.org.pl. Uwielbia ponarzekać, ale oczywiście konstruktywnie i z umiarem. Na forum pisze pod ksywką Canaton.