Anthropic i jego Claude zyskują dzięki odmowie zdjęcia zabezpieczeń dla Pentagonu. Użytkownicy odwracają się od OpenAI na rzecz konkurencji, ale sytuacja Anthropica nie jest taka oczywista.

W ostatnich dniach Claude od Anthropica zyskuje na popularności kosztem ChatGPT-5.2, ponieważ firma nie ugięła się przed Pentagonem i nie zdecydowała się na zdjęcie barier bezpieczeństwa. Na współpracę poszło OpenAI, o czym w obszernym wpisie poinformował Sam Altman. Dla niektórych firm był to argument decydujący o tym, z którego modelu ostatecznie skorzystają.

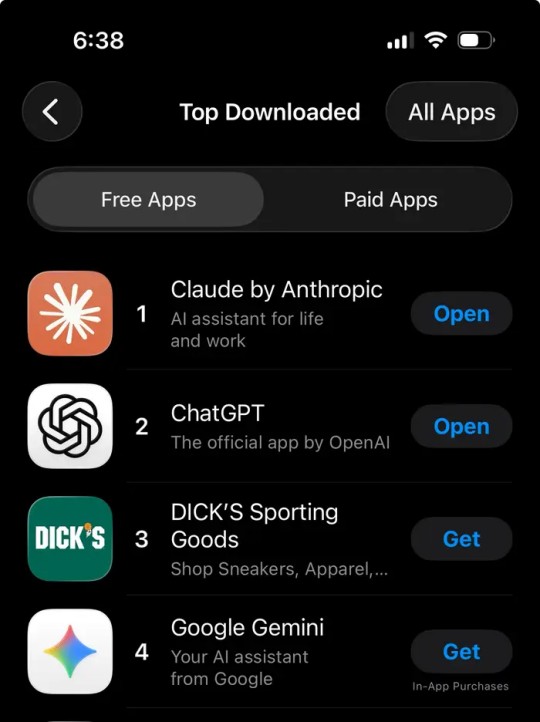

Wystarczyła jedna decyzja OpenAI oraz Anthropica, żeby Claude nagle stał się najchętniej pobieraną aplikacją w App Store w Stanach Zjednoczonych. Business Insider sugeruje, że powodem jest sprzeciw wobec wymagań Pentagonu, który oczekiwał zdjęcia barier bezpieczeństwa aplikacji i komentarze w sieci wydają się to potwierdzać.

Na Reddicie użytkownik Born_Difficulty8309 zdradził, że w jego firmie to był decydujący czynnik:

Jako osoba zarządzająca IT w średniej wielkości firmie, uważam, że to naprawdę istotna kwestia. Analizowaliśmy zarówno Claude’a, jak i ChatGPT pod kątem użytku wewnętrznego, a ta sprawa z Pentagonem była dla nas w zasadzie punktem zwrotnym.

Internauta zwrócił uwagę, że postawa Anthropica sugeruje ostrożniejsze zarządzanie danymi użytkowników. W teorii dane te będą bezpieczniejsze, ponieważ Anthropic nie przekaże ich zewnętrznym podmiotom, podczas gdy OpenAI uchodzi za firmę uległą wobec żądań rządu.

Entuzjaści sztucznej inteligencji wręcz namawiają do rezygnacji z abonamentu ChatGPT i przejście na Claude’a. Zachowanie firmy Sama Altmana nazywane jest „paktem z diabłem” i „sprzedaniem duszy”, a politykę OpenAI wobec użytkowników oraz rządu nazwano bezczelną.

Co za niebywała bezczelność, żeby sypać tymi frazesami o misji dla ludzkości, a jednocześnie sprzedawać się czemuś, co wprost nazywa się „departamentem wojny”. To odrażające i zwyczajnie obłędne. Ironia jest aż nadto wyczuwalna. Po prostu śmieją nam się prosto w twarz.

Pod kątem wizerunkowym firma zyskuje i ludzie powoli zapominają o tym, że jeszcze do niedawna Anthropic był krytykowany za kradzież danych w celu trenowania Claude’a, a szef zespołu badawczego odszedł z firmy tłumacząc się kwestiami moralnymi.

Powołując się na źródła z The Wall Street Journal i Axios, portal Gizmodo zwrócił uwagę, że działania Anthropica nie są takie oczywiste. Dowództwo Centralne USA (CENTCOM) ma korzystać z Claude’a do „ocen wywiadowczych, identyfikacji celów oraz symulowania scenariuszy bitewnych”. Sytuacja nie zmieni się przynajmniej w ciągu kilku najbliższych miesięcy, o czym na X poinformował sekretarz Departamentu Wojny Pete Hegseth:

Anthropic będzie kontynuować świadczenie swoich usług na rzecz Departamentu Wojny przez okres nie dłuższy niż sześć miesięcy, co pozwoli na płynne przejście na lepsze i bardziej patriotyczne rozwiązanie.

Dlatego należy założyć, że ostatecznie uda się znaleźć porozumienie i ostatecznie na całej sytuacji traci wizerunkowo wyłącznie OpenAI. Anthropic zyskuje natomiast nowych użytkowników, mimo że przez najbliższe miesiące nadal będzie kontynuować współpracę z Pentagonem.

Dziękujemy za przeczytanie artykułu.

Ustaw GRYOnline.pl jako preferowane źródło wiadomości w Google

Autor: Zbigniew Woźnicki

Przygodę z publicystyką i pisaniem zaczął w serwisie Allegro, gdzie publikował newsy związane z grami, technologią oraz mediami społecznościowymi. Wkrótce zawitał na GRYOnline.pl i Filmomaniaka, pisząc o nowościach związanych z branżą filmową. Mimo związku z serialami, jego serce należy do gier wszelakiego typu. Żaden gatunek mu nie straszny, a przygoda z Tibią nauczyła go, że niebo i muzyka w grach są całkowicie zbędne. Przed laty dzielił się swoimi doświadczeniami, moderując forum mmorpg.org.pl. Uwielbia ponarzekać, ale oczywiście konstruktywnie i z umiarem. Na forum pisze pod ksywką Canaton.