Nadchodzące RTX-y 50 zostaną pozbawione czujnika „Hot Spot”. Pozwalał on na ustalenie najwyższej temperatury występującej na całej powierzchni GPU.

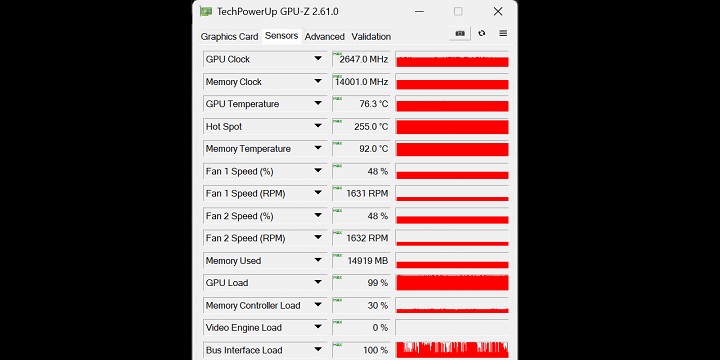

Wczoraj w sieci pojawiły się pierwsze recenzje RTX-a 5090, wskazujące, że Nvidia stworzyła potężną kartę do grania w 4K. Choć nie jest ona pozbawiona wad. Poza wydajnością, recenzenci sprawdzili także temperatury, jakie generuje układ. Ich uwagę przykuł parametr określany jako „Hot Spot”, który cały czas pokazywał wartość 255 stopni Celsjusza. Jak się okazało, Nvidia postanowiła usunąć go, tym samym zmniejszając ilość dostępnych informacji dla użytkowników.

Jako jeden z pierwszych, omawianą zmianę dostrzegł Brent Justice, recenzent portalu The FPS Review i twórca programu GPU-Z. Zauważył, że wartość dla parametru „Hot Spot” nie zmienia się. Jak możemy wyczytać z recenzji, początkowo autor założył, że jest to zwykły błąd odczytu. Dopiero później doszedł do wniosku, że czujnik został po prostu usunięty. Prawdopodobnie, będzie on niedostępny również na innych RTX-ach 50.

Wyniki uzyskane przez program GPU-Z. Źródło: The FPS Review.

Obecnie, twórca pracuje nad wprowadzeniem odpowiednich poprawek dla GPU-Z. Oprogramowanie będzie musiało przejść należyte testy. Pełny dostęp do aktualizacji, będzie możliwy prawdopodobnie już w przyszłym tygodniu.

Jeśli obawiacie się, że teraz nie będziecie mieli dostępu do informacji o temperaturach waszego GPU, to nie musicie się martwić. Użytkownicy najnowszych kart od Nvidii wciąż będą mieli dostęp do czujników sprawdzających temperatury samego rdzenia oraz pamięci. Omawiany „Hot Spot” służy do wykrywania najgorętszego miejsca na całej powierzchni karty. Otrzymywane informacje mogły być pomocne przy montażu chłodzenia GPU. „Zwykli” użytkownicy nie powinni zauważyć różnicy. Być może w przyszłości „zieloni” zdecydują się na przywrócenie „Hot Spotu” w innej formie. Jednak na razie nie mamy na ten temat żadnych informacji.

Dziękujemy za przeczytanie artykułu.

Ustaw GRYOnline.pl jako preferowane źródło wiadomości w Google

Więcej:Claude ogłasza Opus 4.8, ale fani AI są sceptyczni co do jego realnych możliwości

Autor: Kamil Cuber

Z GRYOnline.pl związał się w 2022 roku, jest autorem tekstów o tematyce sprzętowej. Swoją przygodę z pisaniem rozpoczynał jeszcze w gimnazjum, biorąc udział w konkursach organizowanych przez producentów z branży elektronicznej. Następnie przy okazji zakupu nowego komputera zainteresował się sprzętem, stopniowo coraz lepiej poznając rynek komputerowy. Zagorzały fan komputerów i gier single-player, choć nie odrzuci też zaproszenia do gry w szachy oraz Foxhole’a.