Z roku na rok jesteśmy świadkami coraz większego rozwoju sztucznej inteligencji. Tym razem japońska korporacja z branży IT, Fujitsu, postanowiła usprawnić rozpoznawanie przez maszyny ludzkich twarzy. Nowa technologia pozwoli AI zauważyć subtelne zmiany w mimice, przez co będzie ona w stanie określić nasze emocje.

Oliwer Stanisławski

Fujitsu Laboratories ogłosiło opracowanie technologii rozpoznawania twarzy, która z dużą dokładnością ma wykrywać zmiany w mimice, spowodowane przez nerwowość czy dezorientację. Wprawdzie Microsoft używa już od jakiegoś czasu narzędzi do wykrywania ekspresji, ale nie są one aż tak rozbudowane. Technologia firmy z Redmond ogranicza się do rozpoznawania ośmiu podstawowych stanów: gniewu, pogardy, strachu, obrzydzenia, szczęścia, smutku, zaskoczenia i neutralności. Narzędzie Fujitsu rozwija system rozpoznawania ekspresji twarzy i pozwoli precyzyjniej wykryć subtelne zmiany, mogące oznaczać np. fałszywość, zażenowanie albo zmieszanie.

Japońska korporacja przewiduje, że nowe rozwiązanie znajdzie rzeczywiste zastosowanie w wielu aplikacjach, a nawet poprawi bezpieczeństwo pracy np. kierowców czy pracowników fabryk. Warto wspomnieć, że jeszcze w ubiegłym roku firmy Fujitsu i Microsoft współpracowały nad technologią sztucznej inteligencji w celu podniesienia wydajności usług opartych na chmurze.

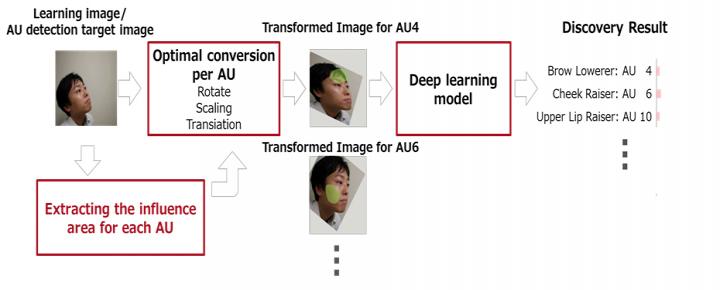

Stosowana do tej pory w branży technologia wykorzystuje system kodowania ruchów, który wymaga ogromnych zasobów danych do prawidłowego funkcjonowania, ponieważ sztuczna inteligencja musi nauczyć się wszystkich zmian mięśni twarzy. Rozwiązanie, które niebawem udostępni Fujitsu, pozwoli wykrywać emocje z dużą dokładnością nawet przy ograniczonej ilości informacji. Analizowana nie jest bowiem cała twarz, a tylko obszary, które mają znaczący wpływ na ekspresję. Rozpoznawanie twarzy będzie działało pod każdym kątem, co więcej, śledzony obiekt może się nawet poruszać – do tej pory problemem była nawet pozycja, w której siedział badany obiekt, bowiem bez patrzenia prosto na kamerę wyniki okazywały się błędne.

Narzędzie opracowane przez Japończyków, nie wyszło jeszcze z fazy badań, ale firma już chwali się wysoką dokładnością swojego systemu. Skuteczność wynosi aż 81%, co oznacza, że technologia jest precyzyjniejsza od innych, istniejących już na rynku (w przypadku Microsoftu mówimy o 60%). Fujitsu dąży do wprowadzenia opatentowanej technologii do użytku komercyjnego – w końcu to konsumenci są najlepszymi recenzentami nowych rozwiązań.

Dziękujemy za przeczytanie artykułu.

Ustaw GRYOnline.pl jako preferowane źródło wiadomości w Google

22