Cyberpunk 2077 - wymagania sprzętowe na PC

Powiedzieć że te wymagania są podejrzane to jakby nie powiedzieć nic, ale jeśli się potwierdzą to zagram na średnio-wysokich na starym gruchocie, więc nic nie mówię xD

A tak ogólnie to nie podniecajmy się, poczekajmy do premiery.

Aż stacja dysków mi się wysunęła z zachwytu

R9 Fury to stara karta z 4GB Vram. Może da radę w 60 klatkach przy wysokich ustawieniach.

Edit. Recka tej karty. W3 60/73 FPS w 1080p

https://www.benchmark.pl/testy_i_recenzje/amd-radeon-r9-fury-x-test/strona/24310.html

Kolejny raz? Przecież Wiedźmin 3 na AMD chodził jak złoto. Z W1 czy W2 również problemów nie miałem, a jak ogrywałem 1 i 2 to miałem kombo AMD&AMD. W3 na RX 470 chodził świetnie, a obecnie mam wrażenie, że chodzi jeszcze lepiej.

kęsik siedzi na 4 letniej grafice która nawet w 2016 roku byla mid-endem i dziwi się że nowe gry nie są optymalizowane pod stare karty.

Kolejny raz? Przecież Wiedźmin 3 na AMD chodził jak złoto.

W żadnym razie. Samo AMD publicznie oskarżało Nvidię o sabotaż wydajności W3 na czerwonych kartach, bo gra na nich przed premierą chodziła dużo lepiej niż po optymalizacji NV.

kęsik siedzi na 4 letniej grafice która nawet w 2016 roku byla mid-endem i dziwi się że nowe gry nie są optymalizowane pod stare karty.

To czemu GTX 1060 jest w zalecanych? RX 470 dogonił przez lata 1060 ale rozumiem według ciebie to Fury w jednej linii z 1060 jest ok? Fury które nomen omen jest jeszcze starszą kartą? To jednak optymalizują pod stare karty tylko niewystarczająco. Śmierdzi słabą optymalizacją AMD na kilometr i tyle, takie można wyciągnąć wnioski po tych wymaganiach. Jednak jak widać sporo osób tutaj woli zaklinać rzeczywistość.

Rany ludzie, ze wy wierzycie w wymagania sprzetowe xD

Wiadomo, ze koniec koncow, porównywalny Radeon bedzie wlasciwie na rowni z porownywalnym Geforcem.

Cudów nie ma

Wiadomo, ze koniec koncow, porównywalny Radeon bedzie wlasciwie na rowni z porownywalnym Geforcem.

No właśnie Gołst nie zawsze tak jest, szczególnie jeżeli w wymaganiach jest duża rozbieżność między kartami tak jak tutaj. Dragon Quest XI ma w zalecanych GTX 1060 i Radeon RX Vega 56 no i zgadnij jak gra działa. Wymagania były podane dobrze, na GTX 970 i 1060 było 60 klatek na max, tymczasem na porównywalnym Radeonie czyli RX 480 o 60 klatach mogłeś zapomnieć.

Wymaganiami to sie ostatnio nie interesuje za bardzo, bo komputer to mi wszystko z palcem w tylku pociagnie, ale nie jedna byla historia, ze gra miala podane dziwne wymagania, a potem sie w rzeczywistoci co innego okazywalo

Tak na szybko przejrzalem ostatnie produkcje jak Marvels Avengers, Horizon ZD itd i kazda z tych gier chodzi prawie identycznie na RX470/480/GTX 1060

Watpie, zeby bylo inaczej, tym bardziej ze mowimy o grze AAA, a nie jakiejs tam bieda gierce z Japonii z portem na odwal sie zapewne

Coś podejrzane te wymagania do rozdzielczości FHD. Czy mając sprzęt lepszy od rekomendowanych, pozwoli on pograć w przyzwoitym FPS z wysokimi ustawieniami bez RT? Czyżby Redzi podołali optymalizacji. :)

wymagania zerowe, prezes Nvidii właśnie zdjął i żuje swoją skórzaną kurtkę.

gra pewnie nie tylko trafi na switcha to jeszcze i na komórki / ale swoją drogą było to do przewidzenia jak ma działać na xbox s gdzie nawet gry indie z bólem działają

wymagania do 1080p do 4K odpowiednio 4x większe :D

PIĘKNIE! Tak się robi gry! Taki Ubisoft nie ma pojęcia o optymalizacji na premierę.

Aż jestem w szoku bo spodziewałem się znacznie większych wymagań a tutaj, niespodzianka, BRAWO!

W końcu się doczekałem, było warto. Gra nie wymaga komputera z NASA i z tego można się cieszyć

Powiedzieć że te wymagania są podejrzane to jakby nie powiedzieć nic, ale jeśli się potwierdzą to zagram na średnio-wysokich na starym gruchocie, więc nic nie mówię xD

A tak ogólnie to nie podniecajmy się, poczekajmy do premiery.

Zauważ, że GeForce GTX 780 (3 GB) i GTX 1060 (6 GB) nie obsługują ray tracking, a do tego pisali, że jest na "full HD". Czyli 1920x1080 bez ray tracking.

Optymalizacja to jest coś na czym (niestety) deweloperzy tną największe koszty produkcji danego tytułu. W większości przypadków firmy olewają grywalność swoich gier, nawet nie wykonując odpowiednich (beta)testów przed premierą. Po czym dochodzi do tego że, aby odpalić jakąś nową produkcję okazuję się, że potrzebny jest nowy sprzęt za kilka tys. bo gra przecież tego 'wymaga'.

Jest to zwykły bullshit marketingowy, a większość ludzi łyka to jak pelikany. Gracze lubią sobie myśleć, że są najbardziej wymagającą grupa użytkowników i zamiast zródła problemów szukać w lenistwie deweloperów, szukają go w braku mocy obliczeniowej. Wszystkim to na rękę, bo deweloperzy nie muszą się aż tak starać, producentom sprzętu rynek rozwija się o wiele szybciej, a gracze korzystają z obu tych rzeczy.

Jest pewien program od niezależnego programisty, który obnaża większość mitów dot. optymalizacji: [link] Sprawdza się zarówno na słabszym, jak i na lepszym sprzęcie.

A tak ogólnie to nie podniecajmy się, poczekajmy do premiery

Do premiery pozostało już tylko 52... lat, na pewno zgram o ile dożyje i zdrowie mi na to pozwoli w końcu będę mieć 89lat :)

A tak na serio to słyszałem, że CP2077 ma ogromne problemy techniczne i wcale się nie zdziwię jak przełożą premierę na I kwartał 2021

O kij, jakie niskie, nawet moj stary PC zalapuje sie na rekomendowane. Czuje ze gra zaliczyla srogi downgrade jak wiedzmin 3

Przecież niedawno było parę filmików porównujących pierwszą większą prezentacje z najnowszymi i było widać, że grafika nie zaliczyła downgrade'u, a upgrade. :) Myślę, że to raczej dzięki usunięciu paru pomysłów, może mniej NPCów, zawartości, itd. itp.

https://www.youtube.com/watch?v=HKDekwjd2eM

Niby niskie, ale przypomnijcie sobie jakie wymagania mial rdr2, a jak chodził?

Ja Wam tylko przypomnę, że RDR2 też ma w zalecanych GTX1060 a jak gra chodzi to wszyscy wiedzą;)

Bo Rockstar zawsze daje d**y jeśli chodzi o optymalizację na PC. Patrz: GTA IV / RDR2

RDR2 na tej karcie w ustawieniach średnich osiąga średnio 50 fps a w ustawieniach wysokich nie spada poniżej 30 Myślę, że to nie taki tragiczny rezultat

RX 580 i Ryzen 5 2600 - RDR2 nie schodził poniżej 55 klatek na wysokich

Juz widze ta stabilnosc w rtx1060, w wiesku jest problem, a co dopiero w cyberpunku hahah, chyba ze kolejny downgrade wpadnie

P.s. Zalecane i juz nie ma podjarki uzycia rtx co rowna sie uzycia wydajnych ukladow z rtx i to nawet nie 2060 :) bo on sobie kiepsko radzi z rtx

W wieśku jest problem? Chyba mając wszystko na uber. Wystarczy obniżyć zasięg rysowania, ewentualnie cienie i zero spadków.

Primo, wymagania wymaganiami, rzeczywistosc bywa zupelnie inna patrz RDR2

Secundo, nie mialo byc czasem jakiejs wiekszej roznicy miedzy PC a konsolami? Gdzie wymagania do ray tracingu?

No to niech się okresla do czego one sa

Tak hucznie zapowiadali RT w tej grze, a teraz co?

Coś to wręcz niemożliwe. To by oznaczało królową optymalizacji :) Ciekawe czy 2080ti/3070 styknie do 4k 60

wezcie pod uwagę ze wiesiek 3 w rekomendowanych miał gtx 770 a tak naprawdę do maksymalnych ustawienień w 1080p potrzebny był gtx980 albo nawet 980 ti. No i na 100% te wymagania są do ustawień bez Ray Tracingu. Raczej ustawień konsolowych.

Ja do wieśka spełniałem lekko ponad wymagania minimalne, a grałem w niego na ustawieniach wysokich bez większych problemów (miałem około 30 klatek). Jak się włączyło ultra i bajery od Nvidii to gra chodziła może w 5-10 klatkach. Tutaj pewnie będzie tak samo, czyli na wysokich będzie można spokojnie pograć, ale na ultra i inne bajery to trzeba będzie mieć już całkiem mocarny sprzęt.

Ogólnie wiesiek był dobrze zrobiony i zoptymalizowany (przynajmniej na PC), więc myślę, że i tutaj będzie ok. Teraz spełniam niby wymagania rekomendowane więc może nawet w ultra sobie pogram, ale na cuda typu RTX i inne bajery nie mam co liczyć.

No to jestem w miarę spokojny o optymalizację na PS4 ;)

Podawane wymagania to kpina już w to uwierzę że GTX 1060 będzie miał na ultra w 1080p 60 FPS.

Nawet CDP stosuję się do podawania mniejszych wymagań niż tak naprawdę ta gra potrzebuje.

Ultra i GTX 1060? Mam nadzieję, że podoła w wysokich, zachowując płynność na poziomie 60FPS

Strzelam że wymagania rekomendowane tyczą sie 1080p/30FPS na średnich max więc i tak nie jest tak źle.

Faktycznie. Uderzające podobieństwo.

E tam, toż to Cul de Sac z Ed, Edd i Eddy.

Na moim 2-letnim GTX 1070Ti wysokie ustawienia na spokojnie. Tyle by było z kupowania superkomputera RTX do Cyberpunka haha

Super, nie jest źle, nawet mój laptop by to ogarnął, ale i tak biorę na PS4. Wygląda w każdym razie, że się przyłożyli, a patrząc (po steamowych ankietach) jaki ludzie mają sprzęt, to wielu pewnie odetchnie z ulgą.

Zresztą gra jest długo w produkcji, musi chodzić też na słabiutkim xbox one, no i nie wygląda też jakoś wybitnie, trochę ten ich red engine zajeżdża plastikiem. A skoro tak, to przy takich wymaganiach wstydu nie ma, o ile gra faktycznie będzie chodzić przyzwoicie na sprzęcie podanym w wymaganiach. W każdym razie odetchnąłem z ulgą, wielu pogra komfortowo, ja też :)

Mogę spać spokojnie Przy RTX 2070 super gra mi pójdzie bez problemu ale tak wymieniam na RTX 3070 super będzie grane do rana

To ja się spodziewałem rtx3800 w minimalnych i z 200GB na dysku, a ci wyjeżdżają z gtx1060 w rekomendowanych i TYLKO 70GB na ssd. Z drugiej zaś strony redzi stworzyli jak narazie 5 gier i żadna z nich nie miała problemów z optymalizacją więc myślę że możemy im zaufać.

Normalne wymagania do gry bez RT, z RT wszystko na Ultra w 4K lub 8K to i RTX 3090 klęknie.

Warto wspomnieć, że wymagania odnoszą się do gry w Full HD.

"Also note that the minimum is created with Low settings and 1080p gaming in mind and Recommended with High and 1080p."

Nie wiem w czym problem? Nastawiliscie się na grafikę rodem z filmu lowca androidów i teraz szok ze małe wymagania? Przeciez ta gra miala downgrade graficzny i widać to gołym okiem , to co pokazano w ostatnim gameplayu to nic co może zachwycić, są gry z lepszą grafa i wyższymi wymaganiami, akurat dla mnie wszystko jest z wymaganiami ok, nie zapominajcie tylko ze to wymagania rekomendowane do gry 1080p.

https://www.youtube.com/watch?v=HKDekwjd2eM&ab_channel=Cycu1

Faktycznie, gołym okiem widać ten downgrade.

Srutu tutu Panie Creed

A czy przypadkiem wersja z 2018 nie była wersja na XBOX One X emulowana na PC a wersja 2020 to wersja PC z włączonym ray tracingiem etc?

Nie znalazłem żadnej wzmianki, że z E3 2018 miałaby być to wersja emulowana, tylko podano specyfikacje komputera, na którym odpalono.

Podczas wybierania opcji dialogowych obok wyboru masz charakterystyczne dla konsoli przyciski X aby zaznaczyć wybór, po za tym wiekszosc sceny Cyberpunka była przedstawiana podczas konferencji Xboxa , podczas e3 przy scenie xboxa i w 2019 gdzie pokazal sie Keanu Reaves , to też była impreza xboxa

Żeby nie było gry na komsole tworzy się na PC wiec odpalano na high end pc aby działało bez przyciecia

Autorze, a gdzie informacja o SSD? W końcu nawet w minimalnym jest zalecany dysk SSD, a w rekomendowanych już wymagany.

Co do samych wymagań- spokojnie, na ultra będziecie mogli wykorzystać moc swoich kart (i procesorów). Nie wspominając już o ray tracingu oraz wyższych rozdzielczościach.

Zresztą Wiedźmin 3 też odpalał się na wielu konfiguracjach, a mimo to na ultra potrafił dać wycisk.

W minimalnych na stronie angielskiej jest podany HDD. Z zaleceniem, że wolą, aby był SSD. Dokładnie tak:

70 GB HDD (SSD recommended)

https://support.cdprojektred.com/en/cyberpunk/pc/sp-technical/issue/1556/cyberpunk-2077-system-requirements

W polskiej wersji zgubili HDD.

Podejrzanie dość niskie wymagania, jestem w szoku, jak tak to zagram bez problemu.

Oby faktycznie z optymalizacją się poprawili.

Nie wiem, skąd takie zdziwienie. Gra wychodzi również na obecne konsole, a najmocniejsza z nich (XOX, dla przypomnienia) ma układ graficzny porównywalny z RX 580. Pi razy oko, poziom kart z rekomendowanych. Druga rzecz, rekomendowane, to nie znaczy 4K + RT. Do tego będzie oczywiście potrzeba czegoś więcej.

Kurcze ilu pecetowcow cieszy się że "im pójdzie". Przecież w graniu na pc nie chodzi o to żeby poszło tylko żeby grać na ultra w 4k 120fps. Byłem pewny że każdy pctowiec ma faktycznie komputer do gier a nie do Worda.

Czy to było do czegokolwiek potrzebne?

Przecież nie zrobią gry która będzie miała w minimalnych podzespoły z nasa. Gra się musi sprzedać więc wymagania są dość niskie ale jednak trzeba mieć już ten i5 w minimalnych. Podejrzewam że jeszcze są osoby które mają i3 czyli dwu rdzeniowe procki. Na szczęście są suwaki na PC więc każdy sobie sam ustawi pod siebie grę. Dla mnie najważniejsze w grze jest jakość tekstur dlatego to ustawiam na maksymalny pułap, a resztę jak woda, cienie, chmury itp to na LOW jak komputer się muli bo to nic nie wnosi do gry.

Czy to było do czegokolwiek potrzebne?

Pewnie nie, ale ile to razy naczelni PCMR przychodzili pod wątek z konsolami/exami tylko po to, aby ponabijać się z 30 klatek i 4k, które było upscalowane. A teraz wchodzisz do takiego wątku o wymaganiach sprzętowych i widzisz, że pełno ludzi się cieszy, że im ruszy na kilku letnich maszynach w 1080p. Taka trochę ironia losu ;)

Wymagania sprzętowe są niewiarygodne, grafika nie jest z pewnością next-genowa, ale to przecież 2020, zaraz rtx 3060 a tutaj w wymaganiach 1060 xD. Ciekawe czy im to wyjdzie

Warto wspomnieć, że gra będzie krótsza (historia) niż miało to miejsce w W3.

https://www.resetera.com/threads/cyberpunk-2077s-main-story-is-shorter-than-witcher-3s-due-to-tremendous-amounts-of-people-not-completing-it.289778/

Jako ciekawostkę dodali obsługę DX12 w Windows 7 (jak np. Blizzard w WoW). Gdyż piszą, że "DirectX® 12 is necessary to run the game."

To było do przewidzenia. Ta gra jest robiona dla konsol starej generacji, więc skąd miały by być jakieś mega wymagania. Poza tym, na PC ma być Raytracing, który raczej przesądza to, że twórcy nie poszaleją aż tak z geometrią i teksturami. W zasadzie pewnie i bez RT ta gra miałaby stosunkowo niskie wymagania. Redzi nie są sprzedawcami sprzętu, tylko gier im więcej potencjalnych klientów tym dla nich lepiej. Po co byłoby robić grę na RTX2070 wzwyż jak graczy z takimi kartami jest mniej niż tych z leciwym GTX1060.

Troche sie tylko zawiodłem na Redach,bo myślałem, że skoro gra ma hyć na Stadię, to udostępnią na PC wersje vulkan albo directx11

Komputer spełniający zalecane wymagania pozwoli uruchomić grę na wysokich ustawieniach graficznych w Full HD.

Ale jak spełnia to pozwoli uruchomić grę w 1080p 60fps czy tylko uruchomić i klatki mogą skakać? Ogólnie same wymagania prezentują się bardzo fajnie, i akurat mam gtx 1060. Ale z zakupem poczekam na jakieś testy na konfiguracji podobnej do mojej.

Też mi tutaj się coś nie zgadza. :X Możemy gdybać, lecz trzeba poczekać na testy.

Jak na gtx 1060 będzie poniżej komfortowej rozgrywki to kupie na PS5, przynajmniej ta gra ma rozsądną cenę.

Podejrzewam, że 1060 to do 30 klatek na sekundę w FHD. Bez RT i jakichś bajerów typu hairworks z W3. Jeszcze w lipcu redaktor z purepc grał w siedzibie cd projekt i tam na 2080 Ti w FHD były dropy poniżej 60 fpsów. Ale od lipca trochę czasu już minęło, mogli to dobrze zoptymalizować.

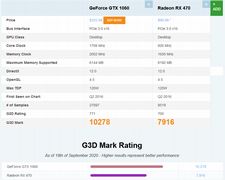

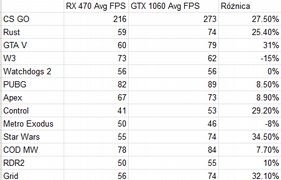

RX 470 jest równy GTXowi 1060 a ten pierwszy jest w minimalnych drugi w zalecanych ;/ Coś podejrzanie to wszystko albo brak optymalizacji dla kart AMD albo znów szemrane interesy z nvidią.

"RX 470 jest równy GTXowi 1060"

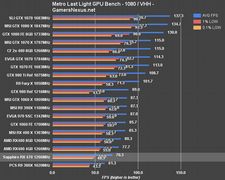

Przepraszam że co? RX 470 jest o 20 do 30 procent słabszy od 1060 w praktycznie każdym możliwym benchmarku, lądując nawet za starym dobrym 970 SCC. W dodatku ma 2gb mniej od 1060 co tym bardziej moze wpłynąć na wydajność bo wygląda na to że gra będzie wymagaja 6-8gb vramu żeby działać na wysokich. Uplasowanie w minimalnych jak najbardziej uzasadnione.

https://www.youtube.com/watch?v=MRDf6pluRLc&ab_channel=54FPS

Myślę, że ten test sprzed 3 miesięcy jest bardziej miarodajny niż ten dupo-screen z Metro LL...

https://www.gamersnexus.net/hwreviews/2544-sapphire-rx-470-platinum-review-benchmark-vs-480-gtx-1060

Wydaje mi się że reputowany recenzent z wieloletnim doświadczeniem i zaawansowaną ekspertyzą będzie bardziej miarodajny niż losowy kanał na youtubie z 3k subów

A o czymś takim jak sterowniki to słyszałeś czy jakoś ci umknęło? Nie od dziś wiadomo, że karty AMD dostają większego kopa po kilku latach za sprawą sterowników i jest to udokumentowane wieloma testami choćby Radeonów z serii R9. Na prawdę nie chce mi się przekrzykiwać zielonego typka z okularami nie widzącymi nic innego niż "green light".

Tak ci tylko podpowiem z perspektywy software'u, że bez sterowników to każda karta nadaje się na złom więc jak firma zwali stery to chyba nie muszę ci mówić co się dzieje.

Bo Nvidia nie aktualizuje swoich sterowników. Chcesz benchmarki z 2020? Proszę bardzo: Statystyka na 18 września 2020 według globalnych benchmarków użytkowników. Rx 470 wciąż 20% z tyłu. Nie ważne jak bardzo będziesz się onanizować swoim filmikiem prawdy nie oszukasz. A o softwarze nie musisz mi nic mówić bo swoim śmiesznym dopiskiem udowodniłeś że mało wiesz w tym temacie, udając profesjonaliste.

I dalej dajesz jakieś suche cyferki nie mające nic wspólnego z rzeczywistością.

A ty dajesz błędne benchmarki pasujące ci po argument, wydaje mi się że stoje trochę wyżej

Jak staniesz na taborecie to może i wyżej. Póki co nie mam zamiaru przekonywać fanboy'a NV do tego, że coś od AMD może mieć taką samą wydajność i być do tego tańsze.

Jasne, pokazuje jak jest na prawdę więc jestem fanboyem. Udowodniłem już że nie ma takiej samej wydajności, a twój filmik porównujący 3GB bieda GTX'a do 8GB karty partnerskiej w nowoczesnym tytule jest uja warty. Też nie mam zamiaru kontynuować tej rozmowy bo to staje się już żałosne, żegnam.

a twój filmik porównujący 3GB bieda GTX'a do 8GB

Och faktycznie nie zauważyłem, że to porównanie 8gb z 3gb. Mea Culpa. Tylko dalej nie zmienia to fakty, że wydajność tych kart jest taka sama bądź wyższa/niższa zależnie od tytułu. Jak tak bardzo o to płakałeś to tu masz bardzo obszerny test 20 i więcej gier w takiej samej konfiguracji i praktycznie w tych samych lokacjach:

RX: https://www.youtube.com/watch?v=i-K3gbZzpIA

GTX: https://www.youtube.com/watch?v=kff6y2cHJnE&ab_channel=GameGangsta

I tym akcentem kończę bo wiem, że mam rację. Tamtą generację kart mam w małym paluszku i wiem która karta ma jaką wydajność.

Na szybko sobie spisałem średnie z filmiku który podałeś w tytułach które były odpalane na obu kartach i jakby nie patrzeć matma wciąż potwierdza moją wersję. RX poza wieśkiem i Watchdogs przegrywa na każdym polu o średnio 16-18% (14.5%, jeśli uznać wiedźmina za anomalie wychodzi 17.2%) zgodnie ze starymi benchmarkami chyba że 30% przewagi w połowie tytułów uznajesz za taką samą wydajność. Skończ się już ośmieszać i zamilknij.

Co wy z tym wieskiem. Ja na moim 2500 k i 1060 spokojnie miałem 75 fpsow, bez hairowrksa i chyba jeszcze.jakisnuber wodotryskowych opcji. Natomiast totalnie ultra opcje kolo 50+, co na takiego wieska bylo wystarczajaco.

Nawet nawet te wymagania, patrząc na minimalne i zalecane widzę że mój sprzęt ogarnie to klasycznie na średnich przy stałych 60 klatkach pod warunkiem że optymalizacja będzie jak należy.

Zaskakująco niskie... i podejrzane...

albo jest to na zasadzie:

minimalne = grafika low

zalecane = grafika mid

???? = uber!

Coś niskie te wymagania.....

Jest szansa, że zagram na średnich w 1080p i nie będę musiał kupować sprzętu za 10 k, jupi

Spodziewałem sie 1070/1080 w zalecanych, nie tyle przez grafike co przez wielkość mapy i ilość detali. Jeśli te utrzymają 60-90 fps w 1080p jak w Rage2 to i tak będzie sukces

Cpu 4 core - rewelacja

Czuję ulgę, że nie muszę zmienić PC, by móc wypróbować Cyberpunk. Nie muszę czekać ponad 2-3 lata, by ulepszyć PC. Mogę zagrać to na High lub Medium. To bez ray tracking, MSAA i takie tam.

Nawet mój GTX 1060 jest na poziomie "zalecany".

Żyjemy w czasach, gdzie gry AAA na medium wyglądają ładnie i to bez pomocą Ultra.

Niskie wymaganie pytacie? Może Cyberpunk jest trochę ładniejszy od Wiedźmin 3, ale zauważcie, że tam nie ma dużo roślinności, co często pożerają duże mocy obliczeniowe.

"ale zauważcie, że tam nie ma dużo roślinności" - cenna uwaga, to powinno nawet w tych 1080p przyzwoicie wyglądać

Bardzo dobrze, zdroworozsądkowe podejście, aniżeli ten wszechogarniąjacy pościg wprost na zbity ryj za liczbami i najnowszym sprzętem. To mi się podoba.

Do tego dostęp do ogromnej bazy klientów. ^^

Kogo stać to i tak nie zmieni planów. Ta grupa nie schodzi już z 1440p i 60 fps to też już totalne minimum.

Sam przyznam że wole z niepotrzebnymi ustawieniami ultra/high (głównie cienie) zjechać niżej by utrzymać 75 fps.

Pamiętajcie, że te wymaganie sprzętowe Cyberpunk nie są wliczone w technologii ray tracking, bo przecież GeForce GTX 780 i GTX 1060 tego nie obsługują. Pewnie zapomnieli o tym wspomnieć.

Jak włączycie ray tracking, to wymaganie sprzętowe znacznie wzrosną.

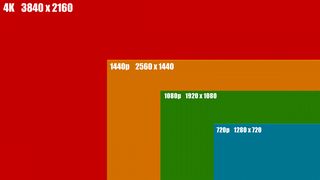

Napisali też o "Full HD" czyli 1920x1080, a nie 2K i 4K. To nie są wymaganie sprzętowe na Ultra, jak ktoś o tym przeoczył.

2K jest często błędnie określane bo raczej chodziło mu o 2560x1440, który jakiś cudem definiuje się 2K w grach.

FullHD to 1920x1080, a ludzie mówiąc o 2K mają na myśli rozdzielczość 2560x1440.

Tyle że 2K (2048x1080) jest mylone z WQHD (2560x1440).

W obrazku od najmniejszego:

HD, FullHD, WQHD, 4K.

Kurde faktycznie. Źle myślałem.

Inaczej niż w kinie gdzie 2k oznacza 2048x1080

W komputerach przyjęto 2k=1440p

https://www.tomshardware.com/news/2k-definition,37641.html

Dobrze myślałeś. Tylko nie wszyscy gracze rozumieją że 1440p to nie 2k.

Ale skoro już wszyscy mają 2k za 1440p to może faktycznie szkoda czasu na walkę z wiatrakami. ;)

Racja. Mój błąd. Dzięki za wyjaśnienie. ;)

Strzelam, że są to wymagania do 30 a nie 60 FPS. Przy 60 może być już inaczej.

Nic dziwnego że takie niskie wymagania sprzętowe skoro z każdym pokazanym gameplayem i trailerem grafika jest coraz gorsza. A animacje i mimika postaci to jakaś niskobudżetowa tragedia, wyglądają i poruszają się jak kukły. Do tego puste miasto. Jak ta gra nie obroni się gameplayem i fabułą to będzie niezły flop.

Chlopie

To kurcze, to oby więcej takich niskobudżetowych gier zapowiadali :-D

Najbardziej ciekawi mnie, jak Cyberpunk 2077 poradzi sobie z PlayStation 4 (slim)... Bo nie wiem czy kupować i liczyć, że będzie w miarę grywalne, ale się męczyć i czekać na PS5, czy najlepiej odwlec zakup gry, aż będę miał PS5...

Bo na moim laptopie, mimo że gamingowy, raczej sobie też nie pogram komfortowo...

Kup i przejdź na ps4 i zrob update na ps5 i 0rzejdz jeszcze raz , ja mam ps4 pro i xboxa one x , kupiłem wersje na xboxa bo na stronie ms mam napisane xbox one x enchanted edition , 4k - ciekawe ile z tego będzie prawda.

Zauważ, że Cyberpunk na PS4 nie będzie ray tracking, ani 60 FPS, a także niektóre opcji graficzne będą ustawione na medium/high. Tylko na PS5 wszystko będzie na ultra.

Tak czy siak, nie zaszkodzi kupić teraz wersji pudełkowej na PS4. Najwyżej poczeka na PS5. Ale nie ukrywam, że kolekcjonuję również gry i bardzo chciałbym dorwać steelbooka jak i dodatki w postaci mapy, pocztówek czy naklejek. Ale nie ukrywam też, że wolałbym kupić Cyberpunka 2077 w nowszej wersji pudełkowej, tej dla gier od PS5. Tylko wtedy nie wiem czy jak będą sprzedawać takową wersję, to czy również dorzucą steelbooka i inne dodatki - podejrzewam, że nie.

Wynika z tego że nadal nic nie wiem, jako że interesuje mnie RT i DLSS. Nie zamierzam skaleczyć tej gry graniem bez RT może to nie zdrowe podejście ale kiedyś trzeba dać tej technologi szansę, u mnie wypada na ten czas.

A oceniając minimalne to wydają się zaskakująco niskie jak na taką produkcję i skalę świata.

Ktoś może w konstruktywny sposób wyjaśnić czemu ta gra wygląda nie tak wcale sporo lepiej od piątki GTA na PC? xD

No bez kitu, Wczesniej to nieco lepiej wyglądało:

https://www.gamersyde.com/news_cyberpunk_2077_gangs_and_districts_from_night_city-21843_en.html

Hola hola porównania do gta zachowajmy jak gra będzie równie dobra. A już mówienie że coś co nie wyszło wygląda lepiej to daleko idące nadużycie.

prawda, to samo stwierdziłęm po nowych trailerach, zresztą nie tylko ja, pracuje z grafikami i to było pierwsze co myśleli jak gadaliśmy o trailerach

Jak dla mnie to wygląda na równi, jak nie trochę lepiej od GTA V. Downgrade może będzie, lecz raczej nie zbyt duży. Gra nadal wygląda bardzo dobrze. Chociaż spotykałem się z opiniami ludźi oglądających najnowszy materiał, którzy uważali, że film został stworzony ze scen z różnych wersji gier tj. z zarówno konsol jak i z PC.

Ktoś może w konstruktywny sposób wyjaśnić czemu ta gra wygląda nie tak wcale sporo lepiej od piątki GTA na PC? xD

Bo wersja next-genowa wyjdzie w przyszłym roku?

Hydro mi parę dni temu mówił ze 1060 nie uciągnie Cyberpunka, hehe.

Pisał też, że nadchodzące Radeony 6000 stracą sens po jego premierze.

Hmm, spodziewałem się więcej niż 70GB...Taki RDR2 ważył ponad dwa razy więcej, mam nadzieję że tu będzie podobnie z zawartością gry. Chociaż oczywiście to inny silnik, więc kto wie jak to wygląda z kompresją.

Wielu już o tym wspomniało wiec potwierdzam. Wymagania obejmuja 30fps zarowno w trybie low jak i high. Założenia są proste - 60 fps przy serii RTX 3xxx na 4K. Nie dziwi Was premiera Cyberpunk tuż po premierze RTXow? :) No ewidentna umowa vendora z devsami....a miałem jeszcze w tym roku brame ogrodzeniową stawiać - cholerny RTX.... :D

Od tego jest kupowanie sprzętów na raty. Po co wydawać od razu 3 tysiaki jak można po 300 co miesiąc.

Raty to męka rozciągnięta na wiele miesięcy. Lepiej raz zapłacić, a potem odbudować oszczędności.

Jak jest stały i pewny dochód to nie ma się co martwić ratami. Ludzie biorą samochody na raty i spłacają znacznie większe kwoty.

Hype ci się udzielił i nie możesz poczekać na premierę Radeonów w przyszłym miesiący...?

nie hype tylko jestem od zawsze "zielony"

Zdecydowanie wolę takie podejście,

Sam kiedyś byłem mocno za nVidią, ale raz kupiłem Radeona... Później miałem jeszcze przez 2 lata 1060 6GB, ale to jednak nie było to, co Radeon. Jakoś mnie oprogramowanie i kultura pracy radków bardziej przypadła do gustu. I generalnie chodzi o to, że Radeon (teraz znowu mam kartę z obozu czerwonych) wg. mnie działa po prostu stabilniej. Wbrew obiegowej opinii :-)

ogrywam właśnie na pentiumie 4, jest ciężko ale mam stabilne 14 klatek

"Jeżeli podali 1060 jako zalecaną, to jak najbardziej"

GTX1060 jest około dwukrotnie wydajniejszy od 1050Ti. Serio, to nie ściema: te karty różni dosłownie przepaść.

GTX1060 jest około dwukrotnie wydajniejszy od 1050Ti. Serio, to nie ściema: te karty różni dosłownie przepaść.

Dwa razy? Nie, co najwyżej 40-50%. Skoro 1060 ma ruszyć na wysokich, to ta pewnie ruszy na średnich.

No tak, patrząc na procenty to za stronką techpowerup 1060 jest wydajniejszy o 60%, jednak patrząc na tflopsy, prawie dokładnie 2x ma ich więcej. Wiem, że z tymi tflopsami to nie do końca taka oczywista sprawa, no ale. Niemniej na niskich - średnich na 1050 ti powinno chodzić.

1050 ti to taki troche radeon rx560 szału nie ma dupy nie urywa...ale kolega ma racje 1060 jest szybszy o jakieś 60% przepaść dlatego w salonach komputerowych wciskają takie karty pokroju 1050ti aby to zeszło za mierną wydajność

Czyżby Redzi poradzili sobie lepiej niż R* w przypadku GTA V? W coś to wątpię, ale zobaczymy - powiedział ślepy.

O czym ty piszesz? 1080p high rekomendowane. 1440p high? 1440p high rt? a gdzie 4K ?

Wiedźmin 3 był bardzo dobrze zoptymalizowaną grą. Można wręcz powiedzieć, że na PC jest jedna z najlepiej ogarniętych gier po tym względem. W3 ruszał na naprawdę słabym sprzęcie. Dlatego tak niskie wymagania mogą świadczyć też o tym, że optymalizacja w CP2077 też stoi na wysokim poziomie. Wiadomo, że obniżenie jakości grafiki też ma tu miejsce, bo to widać na pierwszy rzut oka. W3 też dość mocno został okrojony.

Wiecie grafika nawet jak będzie słaba to nic, bo liczy się gameplay i czy gra działa dobrze i czy jest dobrze zrobiona. Gdyby grafika miała znaczenie to by gry Indie które tak wiem są niskobudżetowe ale są bardzo popularne i bardzo dobrze zrobione, oczywiście nie wszystkie ale większość jest naprawdę bardzo dobrych.

a po ch.. grać w 4k? czy 1440p? komp za 5 kafli żeby zobaczyć pare ładnych tekstur i oświetlenia..weź przestań

Generalnie to preferuję 480px.

Lubię retro klimaty.

Panowie mamy to!!!! Cyberpunk 2077 mi pójdzie :D

Proszę bardzo - wystarczy dobra optymalizacja i 80% sprzętu na rynku da sobie radę bez upgrade :) A gra na pewno będzie wyglądać bajecznie na najwyższych ustawieniach.

Dziwi trochę jedynie podawanie samego i7 w wymaganiach. Ja sam na przykład nie wiem, jak moja i5 stoi w porównaniu z tym i7, mogliby podawać różne rodziny procesorów.

Pytanie też, czy te ustawienia są dla osiągnięcia 30, czy 60 klatek.

Ale stara, czy nowa I5?

Nie spotkałem się jeszcze, z wymaganiami zalecanymi do 30 klatek, później ludzie są rozczarowani i wymagają tych 60 na high. Co więcej, zazwyczaj wymagania są podawane z zapasem.