Nvidia udostępni ray tracing na kartach GeForce GTX

Buhaha zawsze jak ktoś obnaży nvidie (crytek) to zmienia zdanie i wtedy się już da to zrobić. Za jakiś czas się dowiemy, że karty GTX potrafią obsłużyć cały RT.

Buhaha zawsze jak ktoś obnaży nvidie (crytek) to zmienia zdanie i wtedy się już da to zrobić. Za jakiś czas się dowiemy, że karty GTX potrafią obsłużyć cały RT.

To zawsze coś. GTX 1070, GTX 1080 i GTX 1660 zyskują jeszcze większy wartość.

Nie wiem, jak to jest "okrojony" ray tracking, ale czas pokaże.

Testerzy na YouTube będą mieli o czym testować. :)

może nie doczytaliście ale w takim metro gdzie jest największe obciążenie na promienie macie tylko 20 klatek .... na 1080ti . czyli 1080 wcale sie nie nada

Jak dajesz wszystko na Ultra, w tym MSAA na max, to wcale nie dziwię się.

Chyba wlasnie o to chodzi, kupujac nowa karte, masz mozliwosc dac wszystko na ultra.

Co mi po RT na GTX 770 (przyklad, bo taka karte wymienialem) jak bede mial 1 fps?

czyli chcesz obniżyć wszystko na minimum by grac na 1080 w RT??? to bezsens bo dostaniesz światła które mogą być robione w sztuczny sposób a stracisz wygładzanie shadery może nawet cienie i tekstury??? RT po prostu jest drogą technologią i trzeba sie pogodzić że amd czy nvidia bez rdzeniów ray nie ma sensu. Już lepiej przeznaczyć to na 4k albo 1440p

Po pierwsze, to 1080 nie jest żadną nową kartą, więc argument o wszystko na ultra chybiony.

Po drugie niekoniecznie trzeba zjeżdżać "ze wszystkim na minimum". Wystarczy poczekać na testy w 1080p, bo to nadal dla większości graczy jest rozdzielczość w jakiej grają. I wtedy może okazać się, że z wydajnością 1080/ti jest dobrze i ray tracing można mieć w cenie kilkukrotnie niższej od rtx2080/ti.

Karty z serii RTX przestaną być jedynymi obsługującymi ray tracing. Firma Nvidia wypuści wkrótce sterowniki, które dodadzą taką funkcję dla układów z rodziny GeForce 10.

To gracze płacili masę pieniędzy za nowe karty graficzne, a to wszystko można było zyskać dzięki sterownikom?

Wiedzieli o tym od zawsze, ale co tam.

To tylko pokazuje żeby przestać kupować ich karty :) ich zagrywka jak i zagrywki Intela sprawiły że jakbym miał teraz składać kompa to bym poszedł w AMD .

Przeciez Nvidia nigdy nie twierdzila, ze nie da się odpalić raytracingu na kartach Pascal, tylko nie wspierali tego ponieważ te karty oferują zbyt niska wydajność. Co ci po raytracingu na Pascalu skoro wydajność będzie bardzo niska, spojrz na karty z serii rtx, maja wyspecjalizowane jednostki, żeby przyspieszyc obliczenia a i tak wydajność na kartach jak 2060 czy 2070 jest daleko od zadowalającej.

@13

Ty tak poważnie? Nie wiem czy wiesz, ale wszystko, co widzisz na ekranie w grach, to zaprogramowane efekty. To samo możesz osiągnąć tylko za pomocą procesora..., tylko że wtedy musiałby to być procek z NASA i to nie jeden. O to właśnie chodzi, że karty graficznie obsługują wszystko SPRZĘTOWO.

beda mieli raytracing na 1060 w 2kl/sek i w koncu zrozumieja ze 2080 to nie 1080 z doklejonym suffixem rtx.

bardzo dobry ruch nvidii, edukacyjny

A komu ten szrot potrzebny ? To nie zmienia praktycznie w ogóle gry, tylko zabiera mase wydajności. Na obecną chwilę useless shit.

@hasatti Technika raytracingu jest promowana, ponieważ umozliwy przyspieszenie powstawania nowych gier. Gracze oczekują dużych, otwartych swiatow z coraz piekniejsza grafika co pochlonia mnóstwo czasu i pieniędzy uzywajac standardowej techniki renderowania. Budzety gier stanowią coraz poważniejszy problem dla wydawcow, technika raytracing ma te koszty obnizyc i to jest glowny benefit wprowadzenie tej techniki. Gdy budżety gier będą peczniec coraz bardziej, wydawcy coraz mniej chętnie będą pakowac się w jakies ryzykowne projekty, już teraz wiele gier AAA jest do siebie podobnych, gdyż wydawcy nie chcą ryzkowac, ze utopia dziesiątki milionow dolarow.

Przecież to specjalnie pokazane. Crytek jak by nie pokazał to oni też nie. A teraz obrócili kota ogonem i dają wykresy jakie to wspaniałe są RTXy bo miażdżą GTXy i pokazują to dokładnie na wykresach, bo RTXy zalegają w magazynach. Nvidia to taka hiena foko wąż. :) Niech się pałują ze swoim Ray Tracingiem który dla mnie jest kompletnie bezużyteczny za taki pobór wydajności. Zwykłe odbicia które i tak mamy tylko gorsze. PFF TFUUU

Lutz, Crytek pokazał ray tracing na karcie AMD, działa również na innych od "czerwonych" jak i od Nvidii.

Ale dobrze że ten Ray tracing już jest bo za 2 generację już nie będzie tak spadała wydajność :) im wcześniej coś wprowadza tym szybciej ktoś w końcu wykmini jak to dopracować

Jak technologia zostanie dopracowana to kupię sobie kartę pod ray tracing a na razie sobie odpuszczę. To mi przypomina historię jak kolega kupił sobie (wtedy nowość) smartwatcha. Ja zapytałem się po co mu to? A on zaczął wymieniać funkcje a ja spytałem się:

- Ale musisz mieć telefon w pobliżu?

- No tak...

- No to chyba lepiej już używać telefonu?

Zatkało go. Po chwili mówi:

- Ale telefonu nie użyjesz np. w trakcie biegania!

- Przecież ty nie biegasz? - mina bezcenna.

To nie ma sensu skoro na swoim GTX 1080 będę miał z RT trzy razy słabszą wydajność niż na RTX 2070.

To ma sens, jeśli chcesz zostać przez kolejną generację przy rozdzielczości Full HD. Wtedy GTX 1080 zyskuje drugie życie i nagle okazuje się, że np. zakup/zostanie przy takiej używce będzie bardzo opłacalny dla ludzi, którzy chcą cieszyć się ray tracingiem bez wydawania 5k na nowego rtx 2080.

Dodatkowo to testy od Nvidii, one w założeniu mają graczom podkreślać różnice na korzyść rtx, więc byłbym bardzo ostrożny w wysnuwaniu wniosków co do ostatecznej wydajności GTX1080 czy 1080ti.

Pytanie na co komu ray tracing obecnie.

Niestety używam monitora 2560x1440 więc to trochę większe wymagania niż 1080p. Więc z RT nie będę korzystał.

Kiedyś sprawdzę i nic ponadto. Ten monitor w sumie w dużej mierze zakupiony ze względu na 144hz.

Na razie wszystko chodzi dobrze więc na 2019 i 2020 sądzę będzie spokój.

Jak będę wymieniał to już na TV 4K z dobrym HDR, ale wtedy wiadomo, że cały komputer także będzie trzeba zakupić.

Wtedy będziemy mieli RTX 3080, a Ray Tracing być może nie będzie pochłaniał tyle wydajności. Ostatnio zresztą Alex mi polecał tv 4K z konwersją do 8k, gdzie wymagania sprzętowe będą jak z natywnego 4K, ale obraz lepszy.

Do tego HDR 3000. Telewizor Samsung QE65Q900R 3000 nitów 65 cali.

www.youtube.com/watch?v=Z_WEL0N_sTU

Oczywiscie zaprezentowali wyniki na 2080 zeby moc odpalic DLSS w tej rozdzielczosci bo na 2080Ti musieli by uzyc juz 4K, a do tego pisanie o Tomb Raiderze jako grze z DXR jest lekko na wyrost bo co najwyzej za kilka dni dadza znac czy ta gra w koncu bedzie miala obsluge DXR czy musza jeszcze pare miesiecy nad tym popracowac.

Jesli juz ktos chce porownywac wydajnosc to proponuje porownywac wersje z 10xx do wersji 20xx bez DLSS.

Ja mam 1080gtx w SLI, chciałym napisać, że to mogłoby dobrze razem zadziałać np zrzucić RT na jedną kartę, ale juz się nauczyłem że nie warto iść w SLI. No i swoją drogą po co mi ten RT w grach które i tak nie kupie i nie jestem zainteresowany... Szkoda, ale muszę poczekać, aż rynek się rozrusza w tym temacie, potem kupi się nową kartę, może coś fajniejszego niż 2080Ti na tą chwile, bo dupy ta karta nie urywa.

Z jednej strony rozumiem, że trzeba rozwijać nowe technologie aby pchać grafikę do przodu, z drugiej jednak strony, nie rozumiem ray tracingu, który zabiera mnóstwo klatek. Ja mając wybór średnio/wysokie detale 60fps, a ultra na 30-50, zawsze wybiorę średnio/wysokie i 60 fps, bo gra się po prostu dużo przyjemniej. Oczywiście mowa tutaj o średnim użytkowniku z kartami typu xx60 na pokładzie, bo jeśli kogoś stać na xx80 lub xx80ti to nie ma tego problemu.

To nie jest informacja dla graczy tylko dla prosumerow.

Dziwnie zbiega sie z jutrzejsza premiera renderera Arnold GPU od autodeska, chyba chodzi o to zeby dedykowany software mozna bylo uzywac na starszych mocnych kartach.

W Metro Exodus nie ma co nawet patrzeć. Bez RT moje 1080 miało "dyszawki" na ultra ustawieniach w 1080p (nie mówiąc o ekstremalnych), słaba optymalizacja gry, przez co brak sensu nawet sprawdzania RT z 1080. Chyba, że 30 FPSów kogoś uraduje. :)

Na rtx2070/i5 8400 z włączonym wszystkim na maxa poza haiworks w 1080p (z ray tracing) jest stałe 60fps - czasem się bujnie 59/61fps. Także bez przesady. Jeżeli grasz na desktopie, to nie zapomnij włączyć planu najwyższej wydajności w opcjach zasilania ( jeżeli tego nie zrobisz, to takie lekkie czkawki mogą sie pojawiać - niby takie oczywiste,ale ludzie o tym zapominają).

Na najnowszym sprzęcie gra powinna działać jak należy, bez żadnych kombinacji użytkownika. :) Na 1080p bez hairworks, teselacji,zaawansowanej fizyki były czkawki kilkusekundowe w lesie i pustyni w postaci nawet -50 FPS. :) Dwie lokacje, które powodują czkawki u większości znacznej użytkowników. To nie wina zasilania, a kiepskiej optymalizacji, którą z łatki na łatkę naprawiają (gdyby było wszystko ok z tym z grą to by nie naprawiali).

to dziwne bo u mnie na 1080TI stałe 60 fps i więcj... wszystko na ultra FH może wina po stronie ramu lub dysku ?

No to pozostaje tylko jedno aczkolwiek jakie fajne pytanie PO HOOOJ mi to!!! ja się pytam? już lepiej żeby dali ten DLSS.

Ludzie powiem tak skoro Raytracing działa dobrze na karcie AMD to nvidia nie zrobi tak że na gtx 1080ti będzie działać 3 razy gorzej niż na RTX2070 bo by się skomprimitowała dają Raytracing teraz do tych kart by potem nie było jak z FreeSync Co nie zmienia faktu że Nvidia wciskała kit by sprzedać nowe karty.

Narazie Raytracing jest i tak zbyt obciążający karty i taki gtx1060 ti nie ma szans by nawet w 30 fps dawał radę.

[link] Zobaczcie co się dzieje gdy RT jest włączony, cieniowanie barierek z przodu jak i ściany z lewej strony wygląda jak na low, owszem podłoga fajniej trochę błyszczy ale czy warto za taką wydajność mieć taką pierdołę ? Obecnie śmiech na sali z RT. (Linku nie widać, wystarczy wejść w artykuł z grą control i RT i zobaczyć od 26 sek do 33 sek ).

nie liczyłbym na super jakość i efekt WOW! na kartach 1xxx

Przecież NV od zawsze wciska kit ludziom, nawet specjalnie tnie wydajność starszych modeli żeby tylko ludzie się rzucili i kupowali nowsze i droższe karty. Nic nowego. Dziwnym jest to, że ich karty są nadal tak popularne. Szczególnie w segmencie mainstreamowym gdzie akurat AMD posiada bardzo dobre, w miarę tanie a bardzo wydajne modele.

O Jezu Alex widzę że u ciebie już całkowity odlot ostatnio. Ja marzę o tym, żeby ludzie przejrzeli na oczy wreszcie i zobaczyli że NV to syf pod każdym względem (zarówno jeśli chodzi o karty jak i technologię) i żeby jej powiedzieli pa pa tak jak ja to zrobiłem 9 lat temu.

kęsik przecież to był żart :) Podejść do tego bez emocji, wybierz to co jest lepsze. W większości segmentów to Nvidia ma lepszą ofertę, cena, wydajność, kultura pracy, wsparcie, dodatkowo technologie. AMD idzie po śladach ale coraz bardziej się oddala. Na ten moment nic nie przemawia za wyborem GPU od AMD i nie mówimy już tylko o High-endzie, ale o praktycznie w każdym przedziale cenowym.

@Rumcykcyk

Za jakiś czas się dowiemy, że karty GTX potrafią obsłużyć cały RT

Jasne, że tak, lecz zapewne w kilku klatkach na sekundę.

Tak jak z DX12 i wsparciem go "tylko w W10".

A Crytek dał demo ray tracing na karcie AMD Vega 56.

DLSS tez na pewno działa tylko specjalnie nie dają.

Wystarczy otworzyć wiadomość. Najgorsza karta, która otrzyma tą funkcjonalność, to GTX 1060 w wersji 6GB.

Ten świat, media, firmy. Wszystko to jeden wielki spisek. Tak samo było z G-Sync.

jak czytam te komentarze to zastanawiam się czym wy jesteście zaskoczeni ?

- RT jest w DXR w DX12 i jest dostępny dla każdej kraty która obsługuje DX12 nie była to technologia zastrzeżona tylko dostępna jest dla wszystkich.

- za obsługę RT odpowiadają oddzielne rdzenie które zostały do tego dedykowane, w przypadku starych układów wszystko będzie opierać się np. w przypadku NV o cuda core, a że wydajność będzie niewielka to co z tego ?

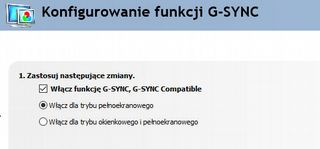

- jeśli chodzi o g-sync to jest to technologia NV oparta na sprzętowej synchronizacji odświeżania obraz względem szybkości wyświetlania klatek, dodane g-sync emulacja dla monitorów obsługujących FS/FS2 wynika z tego że tam było to rozwiązanie oparte o sterownik i możliwości adaptacyjnej zmiany odświeżania. Nigdy nie będzie to tak samo dobrze działać jak przy użyciu sprzętowego rozwiązania

- teraz jeśli chodzi o PhysX to NV od dawna oddała PhysX dla OS dla deweloperów i też jest ona dostępna dla obu kart graficznych

to co NV nie oddała to wszystko co oparte na akceleracji sprzętowej

Unreal Engine i Unity dostaje wsparcie deweloperskie dla RT, a są to dwa najpopularniejsze silniki i zapewne gry będą na tyle zoptymalizowane że RT będzie się dało włączyć na słabszych gpu ale nadal będzie to przepaść w wydajności.

https://www.youtube.com/watch?v=iSGpDMK6xxQ&=

za nim RTX trafiły do sprzedaży było pokazane że wydajność w jednostkach z TC a brakiem tych jednostek to średnio 5:1 ~ 7:1 obok demo 1080ti vs 2080 co dokładnie to obrazuje, niemniej to jest 4K i 4fps na 1080ti więc w 1080p będzie z 20, trochę zoptymalizują i z 25-30 wyciągnie. Jednak każdy woli chyba mieć więcej fps przy użyciu tej technologii.

jeśli chodzi o g-sync to jest to technologia NV oparta na sprzętowej synchronizacji odświeżania obraz względem szybkości wyświetlania klatek, dodane g-sync emulacja dla monitorów obsługujących FS/FS2 wynika z tego że tam było to rozwiązanie oparte o sterownik i możliwości adaptacyjnej zmiany odświeżania. Nigdy nie będzie to tak samo dobrze działać jak przy użyciu sprzętowego rozwiązania

Już ci pisałem w innym temacie, skończ te swoje brednie, bo nie masz pojęcia o czym piszesz jak zwykle, bez wsparcia w skalerze monitora async nie zadziała, to nie jest sprawa wyłącznie oprogramowania, async to jest sprzętowe rozwiązanie i może być tak samo dobre jak gsync.

Nie ma takiego czegoś jak emulacja gsync, takie coś nie istnieje, jest tylko obsługa standardu adaptive sync w kartach nv, który wcześniej sztucznie blokowali.

kaszanka9 - kochany naucz się czytać ze zrozumieniem : dodane g-sync emulacja dla monitorów obsługujących FS/FS2 a nazwali to dokładnie G-sync compatible, co jest oczywiste z tym co napisałeś że dany monitor musi sprzętowo obsługiwać async. Różnica polega na tym że FS/FS2 wykorzystuje rozwiązanie monitor -> sterownik, a g-sync rozwiązanie monitor + chip g-sync synchronizujący -> sterownik. Prościej już chyba się nie da.

haha nigdy i tak bym nie skorzystal z tego czegos. juz lepiej by bylo jakby dali DLSS wtedy bym skorzystal. no ale nvidia wie doskonale ze gracze widac ze z RT na kompie maja tylko 30 fps to wtedy pobiegna do sklepu po te karty ktore pierwotnie mialy byc jedynymi kartami obslugujacymi RT :)

jak dobrze ze jak bedzie premiera ps5 to bede mogl pograc godnie i przyjemnie na konsoli :)

jakość obrazu w tych dwóch grach BFV i Metro Exodus w RT off i on to tak duża przepaść że jak ktoś ma środki na sprzęt i chce grać w najładniej wyglądającą wersję to na 100% tak zrobi. Tak naprawdę jest to nie douwieżenia że dopiero teraz za sprawą RT można uzyskać taki światło-cień czy naturalnie pokazane odbicia, a to dopiero początek. Od premiery Crysis 3 wydawałoby się że już nic lepszego nie zostanie zaprezentowane.

Przepaść to ty masz chyba w widzeniu, różnice w tych grach są wręcz żałośnie pomijalne i nie mają żadnego znaczenia. Wyglądają nawet gorzej niż bez rtx, do tego to ma takie lagi, że śmiech na sali, odszumiasz działający kilka sekund, obracasz się a tam stopniowo zmienia się oświetlenie, jakość, cienie, porażka na całej linii. Coś jak texture pop in tylko ze wszystkim co obsługuje rt i to widać.

kochany kaszanka wróć do pisania jeszcze raz tego samego po zobaczeniu tych gier z RT on, a nie przed, bo potem takie brednie piszesz że tracę czas aby ci odpisywać ;)

https://www.youtube.com/watch?v=Ltcfj9ff0e0

@A.l.e.X ee nie? moze i jest troche ladniejsza ale wciaz nie warta swej ceny. niezbyt duza roznica wizualna a ogromny spadek fpsow i do tego cena za topowe karty ktore mialy byc w stanie uciagnac te RTX.

Skoro Crytek mówił ze ich demo działa na kartach amd i nvidia gtx to znaczy że nie potrzebowali nic odblokować.

Może efekt odbić można uzyskać w prostszy sposób

trzymcie mnie bo im wyj....

RT wykorzystywany w animacji to niebo a ziemia, ale tam nie jest generowany w czasie rzeczywistym i ma wszystkie jego elementy, a nie tylko odbicia. W grach na chwilę obecną to nic specjalnego.

Zastanawia mnie to, dlaczego twórcy/producenci sprzętu porzucili jedną z najważniejszych rzeczy, która była rozwijana, a jest on bardzo istotna.

Mianowicie fizyka twarzy/mimiki.

Kiedyś gry były nastawione na fan i dobrą zabawę, a nie fabułę czy realistyczne przekazanie odbiorcy. Potem zaczęto kombinować właśnie z mimiką twarzy. Może ktoś przypomni, bo nie pamiętam. Swego czasu jakieś studio chwaliło się, że jego model mają ileś tam mięśni i kości twarzy.

Następnie porzuconą to i zajęto się fabułą, to ona stała się najważniejsza - MassEfect, Assasin, W3, GTA4, a teraz znów dostajemy puste wydmuszki, ale za to z milionem efektów i "wodotrysków".

Ile lepszy byłby np. taki W3, gdyby mimika twarzy była jak w animacji CGI. Granie twarzą, to jedna z najważniejszych rzeczy w przekazaniu emocji, ekspresji itd.

Jakby ta scena wyglądała, gdybyśmy twórcy mieli narzędzie do realistycznej mimiki.

https://www.youtube.com/watch?v=KpANomyxkO4

Jak już piszesz o fabule, to weź chociaż wspomnij o porządnych grach, jak NieR, seria Ys, seria Tales of, Kingdom Hearts albo innych grach Made in Japan, Shining Resonance Refrain itp.

A karty Tesla P40? Z takich korzystam i fajnie jakby dostały wsparcie dla RTX mimo, że to zbędny bajer.

Za 10-15 lat będziemy się śmiać z dzisiejszych kart graficznych, jakie to GTX 1080TI, czy RTX 2080TI były kiedyś potężne, a dzisiaj (czyli 2030 rok~) nie można odpalić na wysokich ustawieniach żadnej gry. Jestem ciekaw jakie gry zastaniemy za 10-15 lat, czy już ta grafika naprawdę będzie wyglądała resitycznie i gameplay stanie się też bardziej realistyczny, czy jednak będą co raz to bardziej robić płytkie gry, typu Far cry 5+, gdzie tylko można tępo postrzelać do wszystkiego... A być może nie będzie tak dużego skoku w grafice.

Odpalić na HIGH na obecnych kartach gry za 10-11 lat ?

Nigdy nie było takiej sytuacji, byś na kartach sprzed 10 lat choć odpalił grę na very low. Spróbuj odpalić na GTX 280 wymagające gry z 2018 i 2019. Ta karta z 2008 ma 1gb Vram.

Takie teorie jak będą wyglądały gry w przyszłości były fajne w latach 90', a okazało się grafa wcale nie poszła tak do przodu jak wszyscy marzyli. Bardzo daleko do doskonałości. A na innych polach to gry stoją w miejscu od 20 lat lub nawet zaliczyły regres. Z pewnością co dekadę są co raz łatwiejsze.

na GTX280 nie odpalisz, ale na GTX480 z 2010 juz tak

https://www.youtube.com/watch?v=7DUhF1eOcIs

Nowe konsole za rok, czyli jeszcze przez rok czasu od biedy na tych kartach coś mozna odpalic

Chociaz jak w nowych konsolach nie bedzie jakichs nowoczesnych zastosowań to moze i je odpala te karty, ale bedzie juz za malo wydajnosc zeby na low 800x600 to chodzilo zapewne

GTX 280 dziś sprawdziłem benchmark na dwóch grach z 2008 Stalker - Czyste niebo oraz Crysis Warhead w 1680x1050 na ultra ma średnią ok 20-25 klatek :):):)

Więc jak miałoby to radzić sobie z Crysis 3 z 2013 czy AC Unity z 2014.

Poza tym karta jest przeznaczona do gier z dx10.

A GTX 480 to już inna para kaloszy, bo obsługuje gry dx11.

Karta jest z 2010.

W sumie GTX280 jeszcze miał mocno rozwojowego następcę, ale później były już coraz mniejsze te przyrosty mocy obliczeniowej. Choć, co prawda, i tak spore.

Ale już raptem 7-letnie karty dają sobie radę na luzie do dziś. No, nie na pełnym luzie, trzeba zjechać z ustawieniami do średnich/średnich wysokich, ale mimo wszystko, to jest 7 lat... Mam na myśli Radeona 7970GHz Edition 3GB. Skubany na premierę był potworem, do dziś pięknie napędza gry. Pierwszy lepszy przykład, akurat taką kartę mam u siebie (w szafie, czeka na rebailing):

https://www.youtube.com/watch?v=K_rz1Ak9gOI

Wszystko na tym idzie, a taki Kingdom Come nawet ogarnia 60fps ze spadkami. Wow!

Hola hola od far cry. :)

Tępo postrzelac? Jaki procent gier fps jest bardziej ambitny? Litości

Jaka gra fps z taką mapą może rywalizować w tym kwartale albo może i półroczu z New Dawn?

Masakra. To ten Radeon 7970G z 2012 musiał wtedy być potworem, że daje jakoś radę z KCD z 2018. Ciekaw jestem jakby sobie poradził z AC Odyssey oraz Metro Exodus. Byłoby ciężej.

Patrząc na jakość wykonania dzisiejszych pcb w kartach graficznych do 2030 nie ostanie się żadna gtx z serii 10 xD

Origins jest w tym teście. Myślę, że Odyssey też pociągnie na luzie, z tym, że na średnich ustawieniach. Tak samo Exodus. W Last Light miałem jeszcze przyjemność grać właśnie na Sapphire 7970GHz oraz FX8350. Szło ok, chociaż już tylko na wysokich, nie ultra ;-)

I tak to właśnie jest. Ludzie wtedy kupowali na potęgę GTX670, bo lepszy, bo nVidia, chociaż wcale tak nie było, była to jedynie siła marketingu zielonych. Teraz historia się powtarza - AMD robi lepsze procesory (ogólnie, nie szczegółowo), ale ludzie i tak, jak woły, uparcie idą w architekturę Intela... Ech.

@Kaczmarek35 Z tym, że kiedyś skok jakości grafiki z roku na rok był kolosalny. Obecnie grafika zatrzymała się 10 lat temu na Crysisie, dalej są już tylko marginalne zmiany a wyższe wymagania nie są napędzane jakością tylko tragiczną optymalizacją.

Niebieska zabo : ostatnio gralem z kuzynem w metro last light redux. Obaj na gtx 1070ti . On ryzen 2700x, ja intel 4570/4790k. I obaj z ultra zeszliśmy na wysokie i aliasing 4x. Dopiero wtedy mieliśmy komfort 65-75 fps w FHD

htmzor

Jak najbardziej się zgadzam z Tobą, bo jestem z komputerami od 1989 więc dokładnie tak jest.

Gry z lat 80' i 90' 2d wyglądały dość podobnie. Jedyna różnica, że na Amidze trochę lepiej wyglądały te same gry niż na C-64.

Co ciekawe Pc-towe wersje gier 2d z lat 80' przeważnie były brzydsze niż te Amigowe. Dopiero gry 2d z lat 90' to ten sam poziom graficzny pc względem Amigi. Pc-ty dopiero uciekły AMidze w połowie lat 90' wraz z rozwojem gier 3d.

Gry 3d to duże skoki jakościowe z roku na rok w latach 90', a już tym bardziej co 2 lata kolosalny postęp.

Patrz Alone in the dark 1992, Quake 1996, Tomb Raider 1996, Unreal 1998 itd.

Poprzednia dekada to nadal postęp w grach 3d, ale już wolniejszy. A ta dekada to prawie niezauważalny, bo co raz trudniej uciec konkurencyjnym tytułom choćby sprzed 3-4 lat.

Ale zwróć uwagę, że nawet w tej dekadzie mieliśmy co raz lepiej wyglądające oczy, włosy, mimikę twarzy czy synchronizację ruchu ust z głosem jak grałeś z angielskim dubbingiem.

@Kaczmare35 Ale zwróć uwagę, że nawet w tej dekadzie mieliśmy co raz lepiej wyglądające oczy, włosy, mimikę twarzy czy synchronizację ruchu ust z głosem jak grałeś z angielskim dubbingiem.

Z tym, że to wszystko było w większości możliwe do zrealizowania już w Crysisie, mocno ograniczał ich wtedy sprzęt jakim dysponowali gracze, bo już w wersji premierowej mało kto mógł skorzystać z tego co gra oferowała. To wszystko są detale wprowadzane wraz ze wzrostem mocy obliczeniowej sprzętu komputerowego. Mało jest natomiast jakichś przełomowych zmian jakie miały miejsce chociażby pomiędzy GTA 2 a GTA 3, które dzieli przepaść w niecałe 2 lata. Teraz nie jestem w stanie odróżnić pod względem grafiki gier wydanych 6 lat temu a wydanych wczoraj. Silniki gier miały już lata temu dużo większe możliwości, widać to po tym jak Skyrim potrafi wyglądać na modach. Osobiście wolałbym, żeby gry skupiły się na większej grywalności, fabule i ciekawych mechanikach zamiast upychać coraz to nowe formy oświetlenia, cieniowania i innych cudów w "grach akcji w trzeciej osobie jakich pińcet na ps4".

Crysis w 2007 i 2008 to niszczyciel kompów.

Gry dopiero po ok 5-6 latach po premierze Crysisa wyglądały zauważalnie lepiej.

Mam na myśli głównie poziom detali, gdy przyjrzymy się teksturom danego przedmiotu z bliska np:

Far Cry 3 z 2012 vs Crysis 2007

Ale do Crysis wtedy pojawił się mod z teksturami HD więc znów się bronił. Ale Crysis 3 z 2013 podniósł poprzeczkę mocniej, że Crysis 1 nawet z teksturami HD nie ma szans konkurować graficznie.

Możliwości Dx9 i Dx11 były mocno wykorzystane, ale przy dx10 i dx12 już mieli z tym problem. Teoretycznie na dx12 gry powinny mieć znacznie większą wydajność niż w dx11. Różnica miała być kolosalna, a dopiero przy Shadow of Tomb Raider i Metro Exodus udało się im wreszcie to spełnić, a wcześniej nie było żadnej różnicy dużej na korzyść dx12.

W Rise of Tomb Raider to na dx11 gra lepiej chodziła niż na dx12 co jest wręcz niedorzeczne jakby celowo nie dopracowywali optymalizacji.

Gdyby nie celowe olewanie optymalizacji, obecne RTXy mogłyby równie dobrze nie mieć premiery. Widać to doskonale na tle konsol, gdzie gry w 30 klatkach działają czasami lepiej niż w 60 klatkach na PC. Chociaż zaraz zlecą się ludzie, twierdzący, że 30 klatek na ps4 to taka sama płynność obrazu jak 30 klatek na pc.

Różnice są duże np: Kingdom Come czy Metro Exodus to gry prawie niegrywalne na konsoli Ps4. Widziałem pokaz slajdów u sąsiada mimo jakości coś jak medium z ustawień pc.Wczytywanie 4 razy wolniejsze niż na piecu. Do tego 25-30 Fps.

Mam Ps4 i widzę, że w grach są bardzo obniżone detale, słabsze efekty oraz kiepskie zasięgi widzenia.

Jak masz dobry monitor i przeskoczysz z 30fps na 60fps to jest spora różnica. Identyczni z 60-70fps na 120-130 Fps.

A co dopiero przeskok z 30 Fps na 120-130Fps jak masz monitor 144hz. Śmieszą mnie ludzie, którzy twierdzą, że powyżej 60Fps oko nie zauważy różnicy.

To chyba ktoś używał tylko monitorów 60Hz i 85hz :)

Czyli Nvidia umożliwi mi (mam 1060 6GB) polizanie cukierka przez papierek.

Aż zacytuję samego siebie:

Widać, jak bardzo przepłacili wszyscy, którzy kupili kartę z RTX w nazwie. Ba, rzekłbym nawet, że dali się oszukać. - https://www.gry-online.pl/S043.asp?ID=14848638&N=1#post0-14848994

problem w tym ze to co tam bajdurzysz to klasyczny przyklad internetowego ignoranta nie majacego pojecia o czym pisze.

ale skoro sprawia ci to radosc ..

i co po tych rozbłyskach co to ma być ? pomoże to jakoś w wydajności ? bo wątpię już prędzej te sterowniki mogą spowodować że gry będą chodziły jeszcze gorzej

może o to im chodzi aby dzięki temu ludzie przerzucili się z GTX na RTX hm.

ta technologia może co najwyżej zabrać kolejne FPS powinni się bardziej skupić na prędkości kart graficznych i udoskonalaniu sterowników pod tym względem gdyż

nawet obecne karty mają jeszcze problemy z 4K mowa tu oczywiście o ustawieniach ultra a nie medium czy coś takiego, bo po cholerę mi wysoka rozdzielczość jeśli wszystko pozostałe będzie wyglądało po prostu słabo graficznie to już lepiej grać w full hd i na ultra nie wspominając już o 8K... a oni jeszcze o jakimś Rey trackingu który zabierze na dzień dobry fps to ja dziękuję :)

Nikt nie zmusza do 4k. Na karcie za 4-6 tys zl FHD i wysokie z RT. Komfot plynnej grafiki

Nikt raczej nie kupuje kart za 4-6 tys. by grać w 1080p :)

Ale fakt różnica między 4K, a 1080p na RTX 2080Ti to 60-70Fps do 130-140Fps. Spory przeskok w płynności.

Oczywiście podaje wydajność bez RT.

I to tyle jeśli chodzi o sens zakupu 2080 względem 1080ti. Teraz 2080 noTI nie ma ani jednej karty przetargowej, bo ni to szybsze od 1080ti, ni to wiecej pamięci, (bo mniej).