Nvidia pożegna się z GTX i nazwie nowe karty graficzne GeForce RTX?

Ta wiadomość obiegła już jakiś czas temu. Ale do rzeczy

GeForce RTX 2070 7GB - Co to ma być, mniej V-Ramu od poprzednika! Poza tym stagnacja w ilości V-Ramu dla każdego segmentu to lekka żenada

A tak powinno być:

GTX 2050 4GB

GTX 2060 6GB lub 8 GB

RTX 2070 10 GB

RTX 1080 12GB

RTX 2080 Ti 16 GB

No właśnie sam już nie wiem. Ale w sumie to najmniej ważne. Ważne to cena, dostępność, wydajność, pobór prądu

Z braku realnego znaczącego postępu czy też rewolucji marketing postanowił udawać, że taka ma miejsce, robiąc większy skok w numerkach.

W sumie rzeczywiście nie wygląda to na nic specjalnego i nie dziwi też fakt, że taki RTX 2080 na GDDR6 ma być szybszy od GTX 1080 na GDDR5 o 50% przy 8Gb ramu. Zastosowano tylko i po prostu inny typ pamieci.

Dlatego odpuszczam tą generację. Na razie mój GTX 1080 wystarcza do QHD. Następna generacja to już będzie moja. Pewnie się pojawi w okolicy premiery nowych next-gen konsol

No nie tylko i po prostu inny typ pamieci ale również inną litografię. Tu mamy do czynienia z 12nm a nie 16nm jak przy Pascalach, przez co w znaczącym stopniu zmieniło się upakowanie tranzystorów, a sam proces technologiczny prowokuje również do zmian w architekturze.

RTX zamiast GTX? Olaboga! Kunic śfiata pany! Nic już nie będzie takie jakie było! Kończy się pewna epoka!

GeForce RTX 2070 7GB - Co to ma być, mniej V-Ramu od poprzednika! Poza tym stagnacja w ilości V-Ramu dla każdego segmentu to lekka żenada

Powinieneś się cieszyć, że dają mało RAMu. Im więcej RAMu tym bardziej atrakcyjne dla kopaczy kryptowalut. Nowe karty z większą wydajnością podbiją trudność kopania, a tym samym i zapotrzebowanie na RAM kart. Dzięki temu kopacze w ogóle nie będą zainteresowani 2060 z 5 GB RAM, a karta ta w zupełności wystarczy mainstreamowym graczom do 1080p na ultra, albo 4K z płynnością na poziomie Xbox One X.

No zgadza się, ale przecież świat nie stoi w miejscu i gierki też będą potrzebować coraz to większą ilość V-Ramu. Nowy Tomb Raider Na max. teksturach w 4k, czy przyszłoroczne Metro to może być cienko z pamięcią. A z kopaczami to może być różnie. Teraz tendencja opłacalności na kopaniu jest teraz mała. Może wyjdzie specjalna edycja kart dla kopaczy

No to nieźle. Nie samym VRAMem karty graficzne stoją. Już kompletnie pomijając to czego NIKT z was nie spostrzegł czyli rodzaju tej pamięci. To są pamięci GDDR6, a nie GDDR5. Tak jak kiedyś były te różne karty z ilością 4GB pamięci GDDR3, oraz 2GB GDDR5, i karty z pamięciami GDDR5 charakteryzowały się zdecydowanie lepszą wydajnością. A co do kopania, to tutaj też nie chodzi o ilość pamięci a o jej przepustowość. Bo niech mi ktoś powie dlaczego Radeony Fury miały zdecydowanie lepsze wyniki w zastosowaniach "koparkowych" posiadając jedynie 4GB pamięci HBM? Ze względu właśnie na tą pamięć. HBM czyli High Bandwidth Memory, mimo mniejszej pojemnosci była bardziej efektywna w tych zastosowaniach. Tak więc same Gigabajty to nie wszystko ;)

Zapowiada się nieźle, ja chętnie sprzedam 1080 i zrobię upgrade do 2080 :)

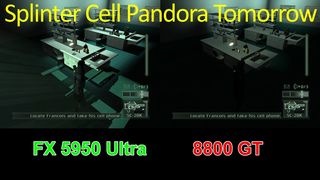

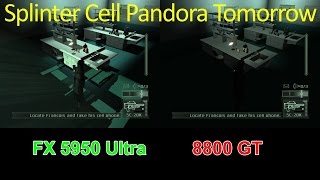

Zapowiada się nieźle, ale mam tylko nadzieję, że nie powoduje to kłopoty ze starymi grami, jeśli chodzi o wsteczna kompatybilność tak jak światło i cieni w grze Splinter Cell Pandora Tomorrow na nowszy GTX, bo zrezygnują z starsze technologii stosowane na starsze karty graficzne.

Minusujcie mnie, co chcecie, ale proszę o sensowne argumenty.

W przypadku (starych części) SC, problemy z oświetleniem występują w 99% kart graficznych, a żeby to dobrze działało trzeba używać coś w rodzaju emulatorów starszych kart graficznych np. dgvoodoo. Bo właśnie akurat w tym przypadku masz rację, że niekiedy niektórych technologii się pozbywają które były w starszych gpu. Tak jak na zdjęciu czy filmiku taki problem jest też m.in. w pierwszym SC.

https://youtu.be/McT32pH_2Iw

Dokładnie. NVIDIA nie zawsze poświęcają czas, by stworzyć specjalne sterowniki dla starsze gry i naśladują starsze technologii kosztem większe obliczenie czyli emulatory. Dla nich to nic trudnego, ale nie zrobią, bo nie ma w tym zysku.

Niektórzy wolą grać w starsze, ale lepsze gry niż w nowsze gry pełno mikropłatności.

A Raytracing w tych kartach

Raczej nie. Te karty co wyjdą po prostu będą za słabe. Jest to chwyt marketingowy. Chyba że w bardzo uproszczonej wersji raytracingu. Ale tak za 2 lub 3 generację kart, będziemy mieli prawdziwą moc do tego modelu obliczeń

Regres w ilości pamięci w przypadku RTX 2070 i częściowo w przypadku GTX 2060 zaskakuje. To każe mi dosyć sceptycznie podchodzić do tych wiadomości. Swoją drogą, gdyby te informacje jednak się potwierdziły, to wydajność GTX 2060 zdecydowanie nie powalałaby.

Po raz kolejny piszę, sama ilośc pamięci to nie wszystko, ważny jest jeszcze jej typ ;)

Sorry, ale to muszą być bzdury, bo nie ma opcji, żebym kupił np. odpowiednika gtx 1060 który miałby mniej niż 6gb, przecież downgrade ramu to jakaś paranoja.

Przecież to jakieś bzdury. W ogóle nie wiem po co GOL kopiuje te rewelacje wyssane z palca (no w sumie wiem, klikalność i reklamy). Sprowadza to jednak ich do poziomu plokta i faktu.

Mniejsza ilość pamieci, jasne, i do tego te wzrosty wydajności 2050 50% lepszy od 1050 ti... ;)

Po pierwsze spójrzcie na typ pamieci a nie samą ilośc, po drugie w przypadku GTX 2050 ważne są same usprawnienia architektury jesli mowa o jakimś wzroście wydajnosci co bezpośrednio wiąże się z 12nm procesem technologicznym.

Nie chodzi mi o to, że wzrost 50% nie jest możliwy, tylko raczej nierealny. Kiedy ostatnio karty Nvidii poprzedniej generacji były, aż o 50% mocniejsze i to od modelu wyższego od siebie, tj. 2050 o 50% od 1050 Ti, a nie 1050.

Co ma za znaczenie rodzaj pamięci. Nowe gry niestety będą rwały z mniejszą ilością pamięci. Spróbuj odpalić ROTR w Ultra na karcie 1060 z 3GB. Nie ma opcji.

Ty to jak to jest że moduły pamięci HBM/HBM2 4GB w kartach np. Fury X są w stanie spokojnie rywalizować z kartami które tej pamięci GDDR5 mają po 6-8GB i im tej pamięci nie brakuje?

(no w sumie wiem, klikalność i reklamy). No nie przesadzaj. Ten portal nie musi się bronić. To są wiadomości szeroko pojętę w internecie, nie wymysł pracowników on-line. Ty musisz się bronić by nie dostać bana

Ja nic nie muszę. To po pierwsze.

Po drugie napisałem prawdę. To nie są żadne fakty, a palcem po wodzie pisanie. Wytłumacz "szeroko pojęte w internecie" (Internet chyba z wielkiej, ale co ja tam wiem).

Ban na GOL-u, o matko co ja zrobię. Rozbawiłeś mnie. Dzięki.

EOT

Inaczej. Poczekajmy na rozwój wydarzeń. Jak będzie oficjalny komunikat co do tego postu w sensie tych kart, to pogaworzymy. Pozdr. dla Ciebie

Amd i ich karty graficzne. No co tu napisać. Brak w najbliższym czasie nowego wysypu kart spod znaku AMD, żle wróży firmie. Chociaż w 2008 kupiłem topowego radeona 4870 za 860 zł i był to kolosalny progress w stosunku do 6800 gt Nvidii kupionego w 2004 roku. I ta, i ich pózniejsza karta R 290 to było bardzo dobre posunięcie. A pózniej tylko kotlety

O tym, że nie ma być serii 11xx tylko 20xx wiadomo może 3 dni, więc komentarze z dipy.

Kto powiedział że brak kart od AMD? W tym roku mają wychodzić Vegi w 7nm na rynek PRO, a w następnym albo Vegi konsumenckie w 7nm lub Navi.

Zwróćcie uwagę na szybkość nowych pamięci i jej przepustowość, a nie patrzycie tylko na pojemność. Pamiętacie kilka lat temu jak mocno były popularne tanie zestawy na allegro z grafiką 2GB (karty typu GT220 itp) ? Co z tego, że miała 2GB jak było mnóstwo kart z 512mb, które były znacznie szybsze.

Ok. Rozumiem że twa myśl to nawet 1 GB v-ramu jest wystarczjąca, jeżeli jest szybka. I ze wszystkim sobie poradzą. Wytłumacz mi twą myśl

Myśl jest taka, że vram ładuje tekstury i w tej chwili chyba nie ma gry, która wykorzystuje chociaż te 6 GB, co tu mówić o 8GB czy nawet więcej. To nie jest tak, że więcej vram=szybsza karta.

chyba nie ma gry, która wykorzystuje chociaż te 6 GB

Jest, Rise of the Tomb Raider, Shadow of War i Ghost Recon Wildlands, przynajmniej z tych co kojarzę.

^ Są, ale tylko niewiele. Działają również na karty 3 GB VRAM.

6-8 GB VRAM to luksus, a nie niezbędny standard.

Wystarczy włączyć solidnie zmodowanego Skyrima i już punktem startowym jest 6GB, bo gra zabiera 4, a co z rzeczami w tle, potencjalnym zwiększeniem rozdzielczości itd.

Dziś to powinna być podstawa przy zakupach na dłuższy czas.

6-8 GB VRAM to luksus

6GB, przy nowym modelu*, to żaden luksus.

* z średnio-wyższej półki

ed: a sam apel niepotrzebny. Ludzie którzy kupują gotowce czy w gazetkach z MM zwracają uwagę na ilośc megapikseli i gigabajtów na pewno nie będą czytać takich wątków.

@Sir Xan

Co z tego, że działają na 3GB VRAM'u? Nie po to daję za kartę trzy i pół koła, żeby za dwa miesiące kupić nową bo tamtej pamięci brakuje.

Myślę że nie zrozumieliscie przekazu xD Dawniej też przecież były różne wersje kart z 4GB pamięciami GDDR3, oraz 2GB GDDR5, i zgadnijcie karty z mniejszą iloscią pamięci były zdecydowanie lepsze od swoich ułomnych pod pewnymi względami braci.

@Kasper001

Jeszcze z 20 razy napisz o tej durnej pamięci, bo nie wystarczy tylko raz. Każdy umie czytać i każdy widzi, że mowa o GDDR6. Tak czy siak lepiej dostać jej więcej w tej cenie niż mniej.

Poza tym to są domysły jakiegoś youtubera które nic nie znaczą. Trzeba czekać na oficjalną zapowiedź.

Pisze pod każdym komentarzem bo widocznie ludzie nie potrafią czytać ;) a te spekulacje mogą miec więcej wspólnego z rzeczywistością niż ci się wydaje.

Niektórzy się narzekają o pojemność VRAM. Pytanie tylko, ile gry na FullHD naprawdę potrzebują aż tyle pamięci VRAM?

Nieważne, ile VRAM oferują karty graficzne, ważniejsze jest to, ile VRAM potrzebują dzisiejsze gry AAA dla grywalność na Ultra. Tylko niewiele gry wykorzystują prawie 6 GB VRAM takich jak najnowszy Tomb Raider, ale nadal działają również na 3 GB VRAM. Więc bez obawy.

6-8 GB VRAM to nadal luksus, a nie niezbędny standard. Twórcy gier nie robią gry, które działają tylko wyłącznie dla elity. Kto wie, co przyniesie przyszłość. :)

Zagraj w nowego Wolfenstaina lub w Resident Evil 7 w 4k

I wtedy napisz że 6 lub 8 gb v-ramu to nic nie znaczy

Prawda i piszę o FullHD, a nie 4K. ;)

Kto gra na 4K, ten kupuje GTX 1080 lub RTX 2080.

Może RTX 2060 i 2070 nie mają tyle pamięci VRAM co poprzednicy, ale za to są SZYBSZE (GDDR6). Różnicy 1 GB VRAM nie wpływa negatywnie na wydajność gry na FullHD. Nie ma po co się narzekać. ;)

Możesz wymagać od NVIDIA o więcej pamięci VRAM, ale trzeba się liczyć również na wzrost ceny. RTX 2060 i 2070 są dla tych, co wolą oszczędzić pieniędzy.

A ja to mam gdzieś czy nazywa się gtx czy rtx czy hiper super bombastic gpu. Niedługo kupuje 1060 /1070 i będę się cieszył ze mogę sobie w nowe gierki pograć. Nie dbam o to że będę miał już wtedy outdated gpu. Tylko niech te cholerne ceny wreszcie spadną.

Nie spadną. Nowa generacja będzie jeszcze droższa i można zapomnieć o niższych cenach. 1160 lub 2060 wycenią na 1600-1700 i po ptakach, 1060 zostanie w tej cenie co jest do wyczerpania zapasów.

NVIDIA nie zamierzają ułatwić życie klientów (łowcy promocji), co wolą czekać na obniżki. Obniżą ceny tylko dla karty (w magazynie), co nie są wystarczające dla nowe gry AAA nawet na 30 FPS (Ultra).

500 dolarów za nową 2070? xD Dobre żarty jak teraz trzeba zapłacić 1700-1800 za nową 1070. Chyba te ceny to w euro

Nowy w przeliczaniu cen? :> Ceny z USA podawane są bez VAT

Czyli lecimy 500 x 3,78 (kurs USD, a można podbić do 3,9 bo trzeba wliczyć ryzyko wahań) x 1,23 (VAT) = 2 325 PLN.

Czyli można spodziewać się czegoś w rodzaju 2 299-2 399 PLN na start.

Jakiś rok temu kupiłem 1060 6GB do Ryzena 1600, najbliższy upgrade szacuję na 2020/21 przy TES6. W tej chwili i tak nie wychodzi nic co by mnie interesowało, a gram głównie w izometryczne rpg pokroju Divinity Original Sin, więc i tak gry tego typu chodzą na ultra w 21:9 75hz bez najmniejszego problemu.

Dziwne bo niby 1080/2080 miała mieć 16 GB VRAM ale cały czas zalewają nas plotki podobnie jak cena na poziomie 700 dolarów. Chyba, że klepią zalegającego pascala na turinga.

Info z dupy, a karty(a szczególnie ilość VRamu) bez sensu, ale ok, kliknięcia same się nie zrobią.

Powinni zacząć od Riva TRT 128

Moim zdaniem co do ceny i nazwy mocno prawdopodobne co do wydajności myślę że zaniżona tak samo jak ilość vramu, na pewno nie robili by rollbacka w pamięciach jak obecnie 4K się standaryzuje w tym tekstury 4K oraz VR.

Swoją drogą przyjemniej by było samo XT.

RTX kojarzy mi się z RTL i RTG, nic specjalnie super-ekstra.

Po co RTX 2080ti skoro 2080 bo to starczy do każdej gry 4k 60 coś? 1080ti po oc juz dosłownie wlosek brakuje, więc 2080 to już max potrzebny.

Niektórzy mają monitor 4k 144hz. A żeby grać na takim monitorze trzeba bardzo mocnej karty. Nawet te karty co się pojawią raczej będą za słabe. Dopiero za 2, 3 lata przy okazji nowych premier kart będzie to osiągalne

Wyłączę vsync i będę miał tyle klatek, ile wyciąga karta.

Cóż, nic tylko życzyć osobom przesiadającym się ze starszych generacji Nvidii na serie 2000 faktycznie wysokiej wydajności i grafiki!

Ja w tym momencie posiadam RX'a 470 8GB od MSI i jako że zależy mi na tym by nie tracić Freesync, a w przyszłości chcę zamienić aktualny model monitora na Samsunga z FS2 i HDR'em, to poczekam do 2019 na Navi od AMD.

Podobno jedna z Navi ma zaoferować wydajność 1080 w cenie 200$ i mi by taka wydajność w zupełności wystarczyła. Ewentualnie wezmę coś mocniejszego ale tak czy tak od Czerwonych, więc mam nadzieję że Nvidia zmotywuje ich do agresywniejszych działań i wydadzą jakieś modele mogące powalczyć chociaż z RTX 2070.

wydaje mi się że dla normalnego gracza wystarczy spokojnie karta GTX 2060 i myślę czy się na takowa nie przesiądę po premierze cena dość znośna a wydajność wydaje mi się że spokojnie wystarczy do grania na ultra w 2k. Tylko ceny coś podejrzanie niskie

Ciekawi mnie czy w końcu taki RTX 1180/2080 (Ti) będzie potrafił utrzymać płynność bez spadków poniżej 60 fps i mikroprzycięć dwie najgorzej zoptymalizowane gry na pc na świecie - gta 4 i saints row 2. Nawet 1080 Ti ma problemy z tymi grami. Crysis przy tych dwóch to pikuś :P

Skoro jest źle zoptymalizowana to możesz sobie nawet cztery 2080 Ti wsadzić i nic ci to nie da.

zapomnieli dodać że jakieś 5 % ludzkości będzie stać na te karty... wiem co mówię bo za swój GTX 1070 zapłaciłem grubo, szkoda gadać z tymi ich cenami normalnie chore niech się leczą., intel to samo to chyba ta sama choroba... no ale cóż choroba ma wiele oblicz.

Patrząc na te ceny i najlepsze gry tylko na konsole nie dziwię się, że wszyscy kupują PS4.

Szczególnie wielbiciele strategii i fpsów mogą czuć się na tej platformie jak w domu.

Mi tam super gra się w Halo Wars na Xbox One. Tornament na PS4 tez super. Kwestia przyzwyczajenia.

Nie mogę oprzeć się wrażeniu, że GTX pojawią się gdzieś za rok może dwa i będą to podrasowane RTXy. Teraz już człowiek nie może być pewny, że jeśli kupi sobie najlepszą kartę z obecnej generacji, to będzie ona najlepsza aż do następnej. Podam jako przykład dajmy na to PS4 Pro.

Co będzie dalej? Telewizory? Lodówki? Już to widzę. Np. Panasonic Ice Cold a za rok Panasonic Ice Gold. Nabijanie ludzi w butelkę. Mam PS4 w wersji zwykłej i ani myślę kupować Pro tak długo, jak ta która mam nie wyzionie ducha.

O!Wcale nie jest tak źle.Gtx 2050 od 100 dolarów do 200 (czyli od 377 do około 750).Stawiam na coś pomiędzy.Myślę że cena będzie oscylować w okolicach 600-650 zł (po doliczeniu "Januszowego").I jeezcze wydajność o około 50% lepsza od gtx 1050 TI.Czyli wydajność o około kilka procent lepsza od gtx 1060 3 gb.Mi to pasuje

Jak to ktoś wyżej pisał 200*3,78 = około 750 * 1,23 (VAT) = 920. Skoro będzie lepsza od 1060 3 GB to i cena podobna. 900 jak nic. Skoro 2060 będzie około 1600-1700, nie licz, że 2050 będzie za 600. Mowa oczywiście o referentach. Autorskie wersje pewnie będą jeszcze droższe.

Według tego newsa gtx 2060 będzie chodzić po 300 dolarów ( maksymalnie) czyli bez opodatkowania 1137 zł.Po opodatkowaniu około 1400 nie 1600-1700.Po za tym nie wierze żeby Nvidia nie zrobiła kastrata gtx 2050 i gtx 2060 które będą o około 20% słabsze.Poza tym są to ceny maksymalne.Mogą być niższe.Ja stawiam na ceny pośrednie:150 dolarów+Vat i 250 dolarów+Vat

Powiem tak z doświadczenia. 960 była za 900, 1060 za 1300, 2060 będzie za 1600 (orientacyjnie). Takie jest moje zdanie. 250 dolków kosztowały 1060, nie sądzę, że Nvidia da taką samą cenę za 2060 i na pewno nie będzie to 1137 bez podatków jakie ci się marzy. Nie mówię tego na podstawie tego artykułu ani wydajności, bo niestety to tylko gdybanie jakiegoś Youtubera.

Niestety Nvidia wie, że nie ma realnej konkurencji i bezlitośnie to wykorzystuje. Takie prawa rynku. Może jeśli AMD wypuści jakąś alternatywę, może Intel niedługo zaskoczy, to Nvidia się ogarnie, ale póki co nie widzę tego.

No fajnie,

To teraz trudno będzie oddzielić internetowe newsy o Nvidii i o Rooster Teeth.

Jak wyjdą to zaczną pojawiać się testy karta vs karta to wtedy się oceni czy faktycznie są lepsze. Na chwilę obecną nie ma co gdybać. To jak wróżenie z fusów.

Efekty zwiazane ze swiatlem (albo hdr) przy kontrascie typowych lcdekow nie maja racji bytu/sensu, w takie gry grac tylko na plazmach i oledach tv bo monitorow takich nie ma.